Аппроксимация Лапласа (пример)

Материал из MachineLearning.

(→Пример 3) |

(→Пример 3) |

||

| Строка 118: | Строка 118: | ||

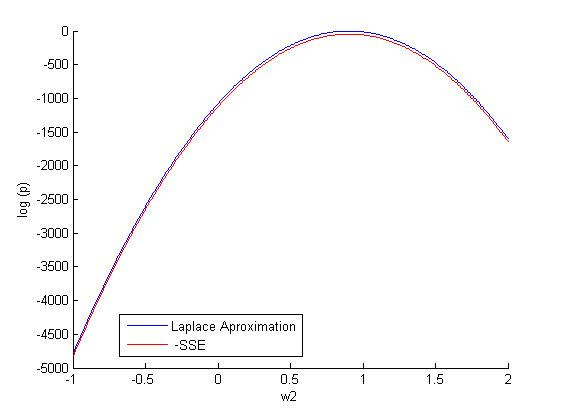

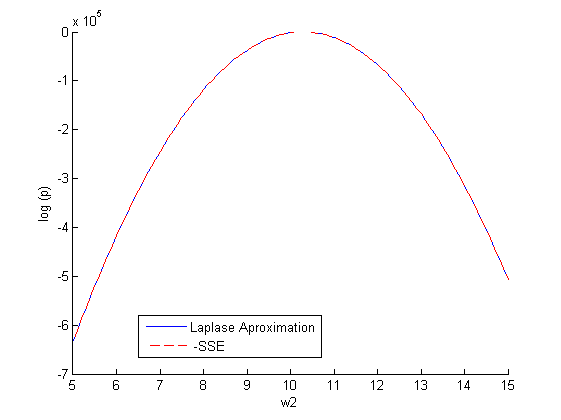

[[Изображение:Non_lin_1_par.png|center|frame]] | [[Изображение:Non_lin_1_par.png|center|frame]] | ||

| + | |||

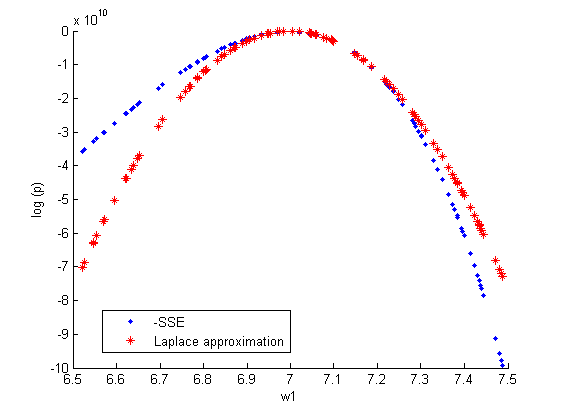

| + | <tex>D_{kl}(p_{SSE},p_{lap})=0.0794</tex>. | ||

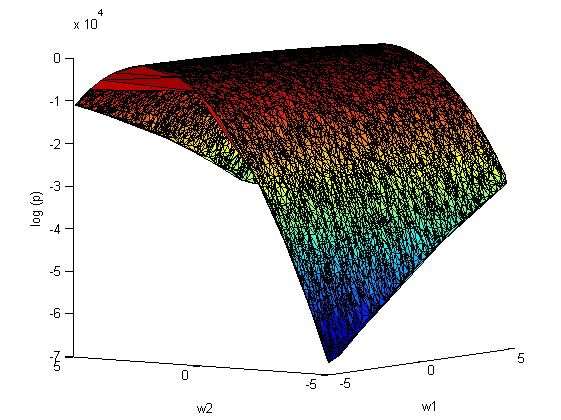

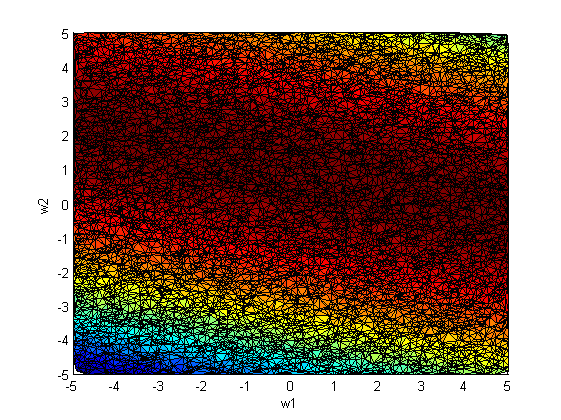

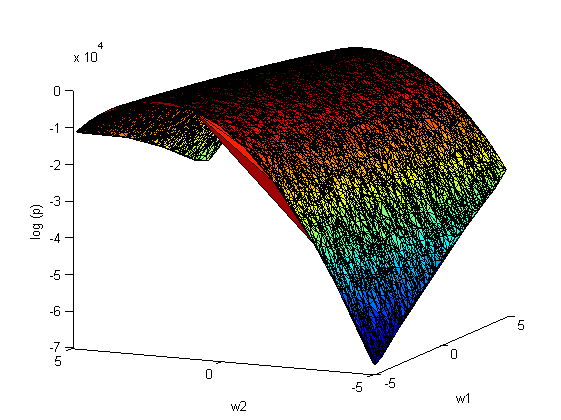

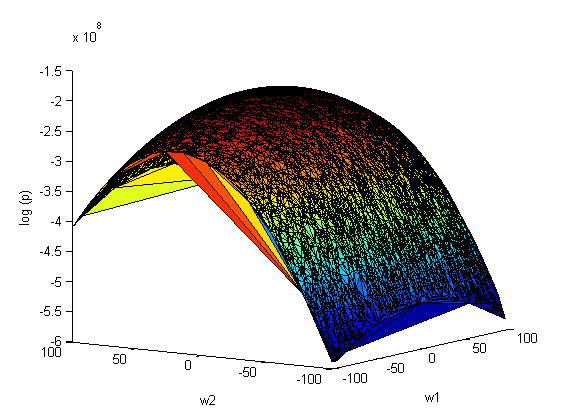

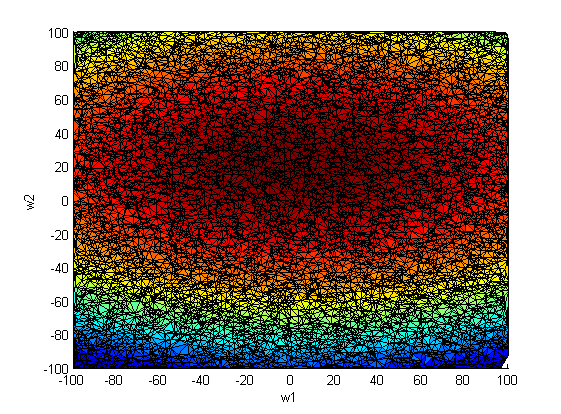

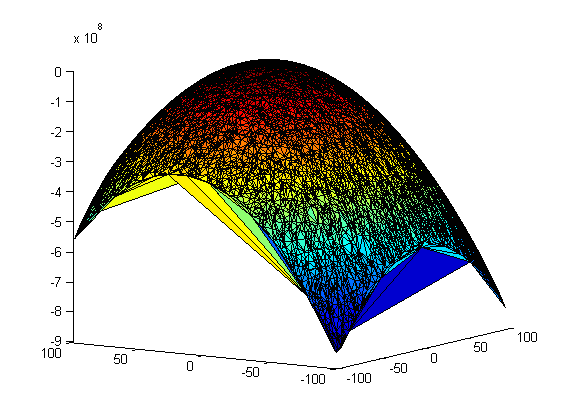

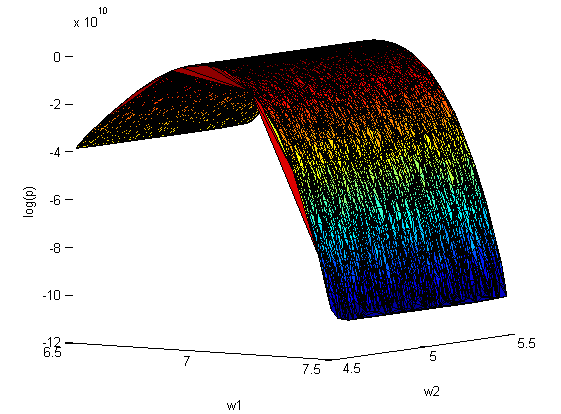

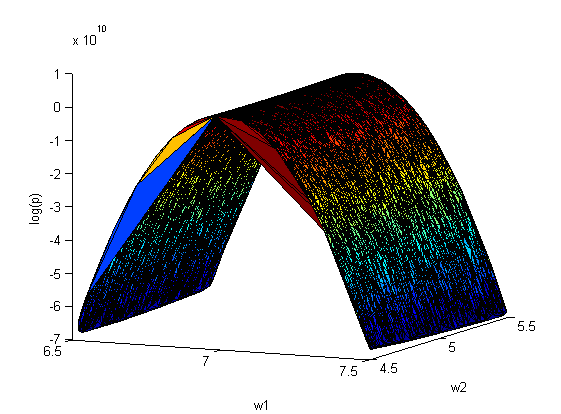

'''Повторим эксперимент''', только теперь варируем сразу оба параметра <tex>w_1</tex> и <tex>w_2</tex>(10000 случайных значений на отрезках [4.5;5.5] и [6.5;7.5] соответственно): | '''Повторим эксперимент''', только теперь варируем сразу оба параметра <tex>w_1</tex> и <tex>w_2</tex>(10000 случайных значений на отрезках [4.5;5.5] и [6.5;7.5] соответственно): | ||

| Строка 126: | Строка 128: | ||

[[Изображение:Non_lin_2_par_laplas.png|center|frame| Laplace Approximation]] | [[Изображение:Non_lin_2_par_laplas.png|center|frame| Laplace Approximation]] | ||

| + | |||

| + | |||

| + | <tex>D_{kl}(p_{SSE},p_{lap})=0.0718</tex> | ||

| + | |||

| + | ковариационная матрица | ||

| + | <tex>A=10^11*\begin{Vmatrix} | ||

| + | -2,7859 & 0.0056\\ | ||

| + | 0.0056 & 0,0146\\ | ||

| + | \end{Vmatrix} | ||

| + | </tex> | ||

== Смотри также == | == Смотри также == | ||

Версия 16:14, 14 декабря 2010

Аппроксимация Лапласа - способ оценки параметров нормального распределения при апроксимации заданой плотности вероятности.

Содержание |

Постановка задачи

Задана выборка — множество значений свободных переменных и множество

соответствующих им значений зависимой переменной.

Необходимо для выбранной регрессионной модели

:

3-1 показать зависимость среднеквадратичной ошибки от значений параметров модели: ;

3-2 построить график и сделать апроксимацию Лапласа для зависимости ;

3-3 найти расстояния между получеными зависимостями, используя расстояние Кульбака - Лейблера.

Описание алгоритма

При востановлении регрессии рассматривалась следующая гипотеза порождения данных:

В таком случае, при фиксированной модели f плотность вероятности появления данных равняется[1]:

- это функция регрессионных невязок, т.е.

;

- нормировачный коэффициент.

3-1. В заданной модели f, используя метод наименьших квадратов, находим оптимальное значение вектора параметров . Далее, фиксируем все параметры выбранной регрессионной модели (для определенности зададим им оптимальные значения) кроме одного (пусть этот незафиксированный параметр будет

). После чего, варируя значение

, строим искомую зависимость

и график

. Таким образом построена зависимость от одного параметра

.

Аналогично действуя, строится зависимость от большего количества параметров.

3-2. При апроксимации Лапласа, полученную в пункте 3-1 функцию приближаем функцией многомерного нормального распределения

. Воспользуемся нелиейной регрессионной моделью:

Другими словами, зная из пункта 3-1 значение (т.е. множество пар

, где

- вектор параметров i-го сэмпла), надо получить корреляционную матрцу

.

Вначале, представляем элементы матрицы в виде вектора параметров. Далее, используя метод Ньютона-Гаусса,нахождим оптимальный вектора параметров (минимум суммы остаточных квадратов). Затем, делаем обратный переход от вектора параметров к матрице и получаем искомую корреляционную матрицу

.

3-3. Расстояние Кульбака - Лейблера между двумя распределениями p(z) и q(z) равняется:

Вычислительный эксперимент

Обозначим плотность распределения SSE как , а его апроксимация лапласса

.

Пример 1

Задуманная функция . Рассматривается линейная регрессионная модель с двумя параметрами:

.

и

- оптимальное значение параметров (при которых SSE минимально).

Фиксируем один параметр и задаем различные значение

(500 случайных значений на отрезке [-1;2]). Строим зависимость:

.

Повторим эксперимент, только теперь варируем сразу оба параметра и

:

апроксимация Лапласса:

ковариационная матрица

На рис.2 наблюдается зависимость между коэффициентами и

. Следовательно, ковариационная матрица

не будет диагональной.

Пример 2

Задуманная функция , где

- белый гауссовский шум. Рассматривается следующая регрессионная модель: линейная комбинация функций

и

.

и

- оптимальное значение параметров (при которых SSE минимально).

Фиксируем один параметр и задаем различные значение

(10000 случайных значений на отрезке [5;15]). Строим зависимость:

Повторим эксперимент, только теперь варируем сразу оба параметра и

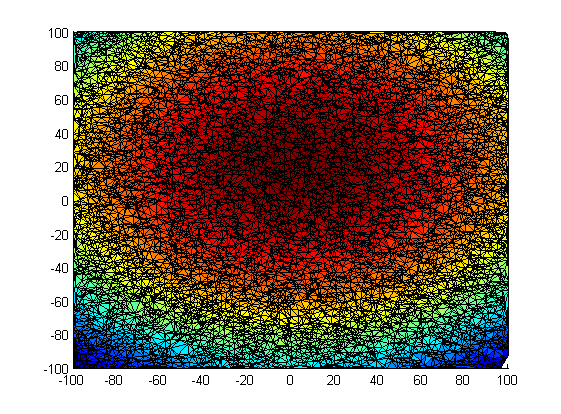

(10000 случайных значений на отрезке [-100;100]):

апроксимация Лапласса:

ковариационная матрица

Пример 3

Задуманная функция , где

- белый гауссовский шум. Рассматривается существенно нелинейная регрессионная модель с двумя параметрами:

.

Фиксируем один параметр и задаем различные значение

(10000 случайных значений на отрезке [6.5;7.5]). Строим зависимость:

.

Повторим эксперимент, только теперь варируем сразу оба параметра и

(10000 случайных значений на отрезках [4.5;5.5] и [6.5;7.5] соответственно):

апроксимация Лапласса:

ковариационная матрица

Смотри также

Литература

- Bishop, C. Pattern Recognition And Machine Learning. Springer. 2006.

Примечания

| | Данная статья является непроверенным учебным заданием.

До указанного срока статья не должна редактироваться другими участниками проекта MachineLearning.ru. По его окончании любой участник вправе исправить данную статью по своему усмотрению и удалить данное предупреждение, выводимое с помощью шаблона {{Задание}}. См. также методические указания по использованию Ресурса MachineLearning.ru в учебном процессе. |