Суммаризация в анализе ДНК-микрочипов

Материал из MachineLearning.

м |

|||

| Строка 20: | Строка 20: | ||

В RMA значения коэффициентов оцениваются при помощи алгоритма median polish<ref name="medianpolish"> Holder, D., Raubertas, R., & Pikounis, V. (2001). Statistical analysis of high density oligonucleotide arrays: a SAFER approach. Proceedings of the ASA Annual Meeting. Atlanta, GA. Retrieved from http://citeseerx.ist.psu.edu/viewdoc/download?doi=10.1.1.142.8156&rep=rep1&type=pdf, </ref>. | В RMA значения коэффициентов оцениваются при помощи алгоритма median polish<ref name="medianpolish"> Holder, D., Raubertas, R., & Pikounis, V. (2001). Statistical analysis of high density oligonucleotide arrays: a SAFER approach. Proceedings of the ASA Annual Meeting. Atlanta, GA. Retrieved from http://citeseerx.ist.psu.edu/viewdoc/download?doi=10.1.1.142.8156&rep=rep1&type=pdf, </ref>. | ||

| + | |||

| + | === fRMA (Frozen Robust Multi-Array Analysis) === | ||

| + | |||

| + | Рассматривается следующая модель уровня экспрессии<ref name="frma">McCall, M. N., Bolstad, B. M., & Irizarry, R. a. (2010). Frozen robust multiarray analysis (fRMA). Biostatistics (Oxford, England), 11(2), 242-53. doi:10.1093/biostatistics/kxp059</ref>: | ||

| + | |||

| + | {{eqno|1}} | ||

| + | ::<tex> Y_{ijkn} = \theta_{in} + \phi_{jn} + \gamma_{jkn} + \varepsilon_{ijkn} </tex> | ||

| + | |||

| + | Здесь используются следующие обозначения: | ||

| + | |||

| + | * <tex>k</tex> — номер партии микрочипов <tex> k \in 1, \dots, K </tex>. Два чипа относятся к одной партии, если эксперименты с ними были проведены в одной лаборатории в одно и то же время. | ||

| + | * <tex>i</tex> — номер микрочипа <tex> i \in 1, \dots, I_k </tex>. | ||

| + | * <tex>n</tex> — номер набора проб <tex> n \in 1, \dots, N </tex>. Также через <tex>n</tex> мы будем обозначать номер гена, соответствующего <tex>n</tex>-му набору проб. | ||

| + | * <tex>j</tex> — номер пробы <tex> i \in 1, \dots, J_n </tex>. | ||

| + | * <tex>Y_{ijkn}</tex> — предобработанная (с вычтенным фоном и нормализованная) логарифмированная интенсивность пробы <tex>j</tex> из набора проб <tex>n</tex> микрочипа <tex>i</tex> из партии микрочипов <tex>k</tex>. | ||

| + | * <tex>\theta_{in}</tex> — экспрессия гена <tex>n</tex> на <tex>i</tex>-м микрочипе. | ||

| + | * <tex>\phi_{jn}</tex> — коэффициент сродства пробы <tex>j</tex> гену <tex>n</tex>. | ||

| + | * <tex>\gamma_{jkn}</tex> — случайная ошибка, вызывающая различия между партиями проб. | ||

| + | * <tex>\varepsilon_{ijkn}</tex> — случайная ошибка, вызывающая различия между пробами на чипах одной партии. | ||

| + | |||

| + | В данной модели предполагается, что пробы на разных чипах имеют одинаковую дисперсию случайной ошибки: <tex>\mathbb{D} \varepsilon_{ijkn} = \sigma_{jn}^2</tex>. | ||

| + | Также делается предположение, что <tex>\gamma_{jkn}</tex> — это случайная величина, дисперсия которой не зависит от партии чипов: <tex>\mathbb{D} \gamma_{jkn} = \tau_{jn}^2</tex>. | ||

| + | |||

| + | ==== Обучение модели ==== | ||

| + | |||

| + | Для обучения необходимы данные с большого числа микрочипов. | ||

| + | |||

| + | Сначала ко всем микрочипам применяется метод квантильной нормализации, приводящий все данные к одному распределению. | ||

| + | В дальнейшем будем называть это распределение «представительным». | ||

| + | |||

| + | Непосредственная настройка модели {{eqref|1}} при наличии выбросов в обучающей выборке крайне сложна, поэтому предлагается перейти к более простой задаче. | ||

| + | Рассматривается упрощенная модель | ||

| + | ::<tex> Y_{ijn} = \theta_{in} + \phi_{jn} + \varepsilon_{ijn} </tex>. | ||

| + | |||

| + | По обучающей выборке находятся робастные оценки параметров <tex>\hat \theta_{in} </tex> и <tex> \hat \phi_{jn} </tex> для данной модели. | ||

| + | Затем вычисляются остатки <tex>r_{ijkn} = Y_{ijkn} - \left( \hat \theta_{in} + \hat \phi_{jn} \right) </tex>, с помощью которых оцениваются дисперсии <tex>\sigma_{jn}^2</tex> и <tex>\tau_{jn}^n</tex>: | ||

| + | ::<tex> \hat \tau_{jn}^2 = \frac{1}{K} \sum_{k = 1}^{K} \left( \bar r_{.jkn} - \bar r_{.j.n} \right)^2</tex>; | ||

| + | ::<tex> \hat \sigma_{jn}^2 = \frac{1}{K} \sum_{k = 1}^{K} \frac{1}{I_k} \sum_{i = 1}^{I_k} \left( r_{ijkn} - \bar r_{.jkn} \right)^2</tex>, | ||

| + | |||

| + | где <tex>\bar r_{.jkn} = \frac{1}{I_k} \sum_{i = 1}^{I_k} r_{ijkn},\; \bar r_{.j.n} = \frac{1}{K} \sum_{k = 1}^{K} \frac{1}{I_k} \sum_{i = 1}^{I_k} r_{ijkn} </tex>. | ||

| + | |||

| + | ==== Обработка новых чипов ==== | ||

| + | |||

| + | Рассмотрим процесс обработки новых чипов. | ||

| + | Сначала делается фоновая поправка всех чипов методом RMA-свертки, затем с помощью квантильной нормализации интенсивности новых чипов приводятся к представительному распределению, полученному на этапе обучения. Последним шагом является суммаризация, которая подробно описана ниже. | ||

| + | |||

| + | В первую очередь делается поправка интенсивностей проб для учета коэффициента сродства: | ||

| + | {{eqno|2}} | ||

| + | ::<tex> Y_{ijln}^* = Y_{ijln} - \hat \phi_{jn} \approx \theta_{in} + \gamma_{jln} + \varepsilon_{ijln} </tex> | ||

| + | |||

| + | (здесь <tex>l</tex> — это индекс новой партии микрочипов). | ||

| + | |||

| + | Далее из скорректированных интенсивностей нужно получить робастную оценку для <tex>\theta</tex>. | ||

| + | Это делается разными способами в зависимости от того, из скольких чипов состоит партия. | ||

| + | |||

| + | ===== Один микрочип ===== | ||

| + | |||

| + | В данном случае индексы <tex>i</tex> и <tex>l</tex> могут быть опущены опущены, так как обрабатывается один микрочип и одна партия. | ||

| + | |||

| + | Логарифмированная концентрация оценивается следующим образом: | ||

| + | ::<tex> \hat \theta_n = \frac{\sum_{j = 1}^{J_n} \frac{w_{jn}}{v_{jn}} Y_{jn}^*}{\sum_{j = 1}^{J_n} \frac{w_{jn}}{v_{jn}}} </tex>, | ||

| + | где <tex> v_{jn} = \hat \tau_{jn}^2 + \hat \sigma_{jn}^2 </tex> — оценка дисперсии скорректированной интенсивности <tex>Y_{jn}^*</tex>, а <tex> w_{jn} </tex> — веса, соответствующие некоторой [[М-оценка|M-оценке]]. | ||

| + | |||

| + | Данная оценка учитывает с низкими весами выбросы (так как им соответствуют маленькие <tex>w_{jn}</tex>) и пробы с большой дисперсией шума. | ||

| + | |||

| + | ===== Партия микрочипов ===== | ||

| + | |||

| + | В данном случае индекс <tex>l</tex> может быть опущен, так как обрабатывается одна партия микрочипов. Число чипов в новой партии будем обозначать через <tex>I</tex> | ||

| + | |||

| + | Введем следующие обозначения: | ||

| + | * <tex> {\mathbf X} = 1_{J_n \times 1} \otimes \mathbf{E}_{I \times I} </tex> — индикаторная матрица (<tex> 1_{m \times n} </tex> — матрица из единиц размера <tex> m \times n </tex>; <tex> {\mathbf E}_{n \times n} </tex> — единичная матрица размера <tex> n \times n </tex>; <tex> \otimes </tex> — [http://ru.wikipedia.org/wiki/Произведение_Кронекера произведение Кронекера]). | ||

| + | * <tex> {\mathbf \theta} = \left( \theta_{1 n}, \dots, \theta_{I n} \right) </tex> — вектор экспрессий. | ||

| + | * <tex> {\mathbf Y_{jn}^*} = \left( Y_{ijn}^* \right)_{i = 1}^{I} \in \mathbb{R}^I </tex> — вектор интенсивностей пробы <tex>j</tex> набора <tex>n</tex> на всех чипах партии. | ||

| + | * <tex> {\mathbf Y_n^*} = \left( {\mathbf Y_{1,n}^*, \dots, Y_{J_n, n}^* } \right)^T \in \mathbb{R}^{I J_n}</tex> — вектор интенсивностей всех проб к гену <tex>n</tex> на всех чипах партии. | ||

| + | * <tex> {\mathbf \delta} \in \mathbb{R}^{I J_n} </tex> — вектор случайных ошибок, соответствующих интенсивностям из <tex> {\mathbf Y_n^*} </tex>. | ||

| + | |||

| + | Тогда модель {{eqref|2}} можно записать в матричном виде: | ||

| + | ::<tex> \mathbf Y_n^* = X \theta + \delta </tex> | ||

| + | |||

| + | Матрица ковариации вектора случайных ошибок <tex> \mathbf \delta </tex> задается следующим образом: | ||

| + | ::<tex> {\mathbf \delta}_{i_1 j_1, i_2 j_2} = cov \left( Y_{i_1 j_1 n}^*,\; Y_{i_2 j_2 n}^* \right) = \begin{cases} \tau_{jn}^2 + \sigma_{jn}^2, & \text{if } j_1 = j_2 = j, \; i_1 = i_2, \\ \tau_{jn}^2, & \text{if } j_1 = j_2 = j, \; i_1 \neq i_2, \\ 0, & \text{otherwise} \end{cases} </tex> | ||

| + | |||

| + | С учетом данного выражения ковариационную матрицу вектора <tex> \mathbf \delta </tex> можно записать следующим образом: | ||

| + | ::<tex> {\mathbf \Sigma} = diag \left( \tau_{1n}^2, \dots, \tau_{J_n, n}^2 \right) \otimes 1_{I \times I} + diag \left( \sigma_{1n}^2, \dots, \sigma_{J_n, n}^2 \right) \otimes {\mathbf E}_{I \times I} </tex> | ||

| + | |||

| + | Для параметров <tex> \tau_{jn}^2 </tex> И <tex> \sigma_{jn}^2 </tex> уже получены оценки, поэтому матрицу <tex> \mathbf \Sigma </tex> можно считать известной. | ||

| + | Значит, с помощью преобразования <tex> \mathbf Z_n^* = \Sigma^{-\frac{1}{2}} Y_n^* </tex> можно добиться независимости случайных ошибок. | ||

| + | Тогда робастную оценку для <tex> \mathbf \theta </tex> можно получить из следующей задачи взвешенных наименьших квадратов: | ||

| + | ::<tex> \left\| {\mathbf W \left( \Sigma^{-\frac{1}{2}} Y_n^* - \Sigma^{-\frac{1}{2}} X \theta \right) } \right\|^2 \rightarrow \min_{\mathbf \theta} </tex>, | ||

| + | где <tex> \mathbf W </tex> — диагональная матрица весов, соответствующих некоторой [[М-оценка|M-оценке]]. | ||

| + | |||

| + | Решение записывается следующим образом: | ||

| + | ::<tex> {\mathbf \hat \theta} = \left( {\mathbf X^T \Sigma^{-\frac{1}{2}} W \Sigma^{-\frac{1}{2}} X} \right)^{-1} {\mathbf X^T \Sigma^{-\frac{1}{2}} W \Sigma^{-\frac{1}{2}} Y_n^* } </tex>. | ||

| + | |||

== Примечания == | == Примечания == | ||

Версия 08:33, 24 октября 2011

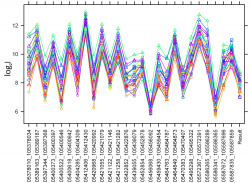

Суммаризация — этап предобработки при анализе ДНК-микрочипов, в ходе которого интенсивности флуоресценции проб, соответствующих одному гену, обобщаются в оценку его экспрессии.

Для обеспечения устойчивости оценки уровня экспрессии к каждому гену на микрочипе имеется несколько проб; их последовательности комплементарны разным участкам последовательности их гена.

Содержание |

Одиночная суммаризация

В данном классе методов оценки экспрессии вычисляются для всех микрочипов независимо друг от друга.

В комплексе методов предобработки MAS 5.0[1] для суммаризации используется взвешенное среднее Тьюки, вычисленное одношаговым методом. Усреднение применяется к логарифмам интенсивностей флуоресценции проб и выполняется независимо для каждого гена на каждом микрочипе.

Множественная суммаризация

К данному классу методов относятся такие, которые для получения оценки экспрессии используют несколько микрочипов.

Интенсивности флуоресценции разных проб к одному и тому же гену могут отличаться на порядки, причём отличия между ними имеют в основном систематический характер. В комплексе методов предобработки RMA[1] делается попытка учесть эти различия в рамках следующей модели:

Здесь — предобработанная (с вычтенным фоном и нормализованная) логирифмированная интенсивность флуоресценции пробы

к гену

на микрочипе

,

— оценка экспрессии гена

на микрочипе

в логарифмической шкале,

— коэффициент аффинитивности

-й пробы

-му гену,

— случайная ошибка с нулевым средним. Для однозначности определения параметров предполагается дополнительно

для каждого гена.

В RMA значения коэффициентов оцениваются при помощи алгоритма median polish[1].

fRMA (Frozen Robust Multi-Array Analysis)

Рассматривается следующая модель уровня экспрессии[1]:

Здесь используются следующие обозначения:

-

— номер партии микрочипов

. Два чипа относятся к одной партии, если эксперименты с ними были проведены в одной лаборатории в одно и то же время.

-

— номер микрочипа

.

-

— номер набора проб

. Также через

мы будем обозначать номер гена, соответствующего

-му набору проб.

-

— номер пробы

.

-

— предобработанная (с вычтенным фоном и нормализованная) логарифмированная интенсивность пробы

из набора проб

микрочипа

из партии микрочипов

.

-

— экспрессия гена

на

-м микрочипе.

-

— коэффициент сродства пробы

гену

.

-

— случайная ошибка, вызывающая различия между партиями проб.

-

— случайная ошибка, вызывающая различия между пробами на чипах одной партии.

В данной модели предполагается, что пробы на разных чипах имеют одинаковую дисперсию случайной ошибки: .

Также делается предположение, что

— это случайная величина, дисперсия которой не зависит от партии чипов:

.

Обучение модели

Для обучения необходимы данные с большого числа микрочипов.

Сначала ко всем микрочипам применяется метод квантильной нормализации, приводящий все данные к одному распределению. В дальнейшем будем называть это распределение «представительным».

Непосредственная настройка модели (1) при наличии выбросов в обучающей выборке крайне сложна, поэтому предлагается перейти к более простой задаче. Рассматривается упрощенная модель

.

По обучающей выборке находятся робастные оценки параметров и

для данной модели.

Затем вычисляются остатки

, с помощью которых оцениваются дисперсии

и

:

;

,

где .

Обработка новых чипов

Рассмотрим процесс обработки новых чипов. Сначала делается фоновая поправка всех чипов методом RMA-свертки, затем с помощью квантильной нормализации интенсивности новых чипов приводятся к представительному распределению, полученному на этапе обучения. Последним шагом является суммаризация, которая подробно описана ниже.

В первую очередь делается поправка интенсивностей проб для учета коэффициента сродства:

(здесь — это индекс новой партии микрочипов).

Далее из скорректированных интенсивностей нужно получить робастную оценку для .

Это делается разными способами в зависимости от того, из скольких чипов состоит партия.

Один микрочип

В данном случае индексы и

могут быть опущены опущены, так как обрабатывается один микрочип и одна партия.

Логарифмированная концентрация оценивается следующим образом:

,

где — оценка дисперсии скорректированной интенсивности

, а

— веса, соответствующие некоторой M-оценке.

Данная оценка учитывает с низкими весами выбросы (так как им соответствуют маленькие ) и пробы с большой дисперсией шума.

Партия микрочипов

В данном случае индекс может быть опущен, так как обрабатывается одна партия микрочипов. Число чипов в новой партии будем обозначать через

Введем следующие обозначения:

-

— индикаторная матрица (

— матрица из единиц размера

;

— единичная матрица размера

;

— произведение Кронекера).

-

— вектор экспрессий.

-

— вектор интенсивностей пробы

набора

на всех чипах партии.

-

— вектор интенсивностей всех проб к гену

на всех чипах партии.

-

— вектор случайных ошибок, соответствующих интенсивностям из

.

Тогда модель (2) можно записать в матричном виде:

Матрица ковариации вектора случайных ошибок задается следующим образом:

С учетом данного выражения ковариационную матрицу вектора можно записать следующим образом:

Для параметров И

уже получены оценки, поэтому матрицу

можно считать известной.

Значит, с помощью преобразования

можно добиться независимости случайных ошибок.

Тогда робастную оценку для

можно получить из следующей задачи взвешенных наименьших квадратов:

,

где — диагональная матрица весов, соответствующих некоторой M-оценке.

Решение записывается следующим образом:

.