Структурные методы анализа изображений и сигналов (курс лекций, А.С. Конушин, Д.П. Ветров, Д.А. Кропотов, О.В. Баринова, В.С. Конушин, 2009)

Материал из MachineLearning.

(Ссылка на новую версию второй лекции) |

м (→Основные графические модели) |

||

| Строка 22: | Строка 22: | ||

Байесовские сети. Элементарные способы работы с байесовскими сетями. Марковские сети. Потенциалы на кликах. Примеры использования марковских сетей для анализа изображений. Ликбез: независимость случайных событий. Условная вероятность. Условная независимость. | Байесовские сети. Элементарные способы работы с байесовскими сетями. Марковские сети. Потенциалы на кликах. Примеры использования марковских сетей для анализа изображений. Ликбез: независимость случайных событий. Условная вероятность. Условная независимость. | ||

| - | [[Медиа:SMAIS-2009-2a.pdf| Презентация (PDF, | + | [[Медиа:SMAIS-2009-2a.pdf| Презентация (PDF, 548 КБ)]] |

=== Марковские сети и дискретная оптимизация === | === Марковские сети и дискретная оптимизация === | ||

Версия 14:32, 17 сентября 2009

| | Статья в настоящий момент дорабатывается. Dmitry Kropotov 18:03, 14 сентября 2009 (MSD) |

Курс посвящен математическим методам обработки информации, основанных на выделении структуры в исходных данных и ее последующем анализе. Эти методы широко используются при решении задач из разных прикладных областей, включая обработку изображений и видео, анализ поведения, распознавание речи, машинное обучение.

Программа курса

Часть 1. Графические модели для анализа изображений.

Введение в курс и понятие графических моделей.

Обзор курса. Задачи анализа структурированных данных. Представление зависимостей между объектами в виде графов. Основные задачи, для решения которых используются графические модели. Демонстрация современных работ, опирающихся на данные в курсе методы.

Напоминание основных понятий, которые будут активно использоваться в следующих лекциях. Основные операции с вероятностями (правило суммы, произведения, формула Байеса). Понятия мат. ожидание и матрицы ковариаций. Нормальное распределение. Независимость событий. Маргинализация (исключение переменной). Метод максимального правдоподобия, МАР-оценивание на примере нормального распределения. Матричная нотация (скалярное произведение, следы матриц, квадратичные формы, дифференцирование по вектору). Правило множителей Лагранжа с ограничениями в виде равенств и неравенств.

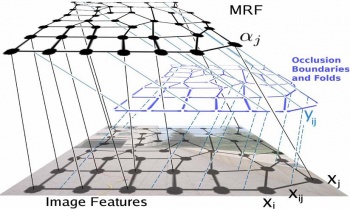

Основные графические модели

Байесовские сети. Элементарные способы работы с байесовскими сетями. Марковские сети. Потенциалы на кликах. Примеры использования марковских сетей для анализа изображений. Ликбез: независимость случайных событий. Условная вероятность. Условная независимость.

Марковские сети и дискретная оптимизация

Энергетическая формулировка задач компьютерного зрения. Разрезы графов, алгоритмы нахождения максимального потока. Интерактивная сегментация изображений. Энергия, которую можно минимизировать с помощью разрезов графов. Многоуровневые разрезы графов. Приближенная минимизация энергии с помощью разрезов графов. Алгоритм, основанный на замене. Примеры минимизируемых энергий. Сегментация видео. Сшивка изображений. Трехмерная реконструкция.

Методы настройки марковских случайных полей

Методы обучения в марковских случайных полях. Применение для семантической сегментации изображений, распознавания объектов с учетом контекста и трехмерной реконструкции.

Алгоритмы обмена сообщениями. Belief propagation и Loopy beleif propagation.

Обзор приближенных методов вывода в графических моделях

Несубмодулярные функционалы. Квадратичное псевдобулево программирование как расширение разрезов графов. Алгоритм TRW как альтернатива Loopy Belief Propagation. Минимизация дивергенции Кульбака-Лейблера: вариационный вывод и Expectation propagation на примере сегментации изображения и пауссоновского трекинга.

Часть 2. Графические модели для анализа и распознавания сигналов.

Скрытые марковские модели. Алгоритм сегментации сигнала

Примеры задач сегментации сигналов. Обучение НММ с учителем. оиск наиболее вероятной последовательности состояний. ЕМ-алгоритм и его использование в анализе графических моделей.

Обучение СММ без учителя

Алгоритм Баума-Уэлша для подсчета условного распределения скрытой переменной в отдельной точке. ЕМ-алгоритм для обучения НММ без учителя. Особенности численной реализации на ЭВМ. Модификации НММ (НММ высших порядков, факториальные НММ, многопоточные НММ, НММ ввода-вывода). Примеры использования НММ.

Методы фильтрации данных

Линейные динамические системы, фильтр Калмана. Настройка параметров фильтра Калмана. Уравнения Рауса-Тунга-Штрибеля. Пример использования.

Методы Монте Карло с марковскими цепями

Взятие интегралов методами Монте-Карло, голосование по апостериорному распределению вместо точечного решающего правила. Схема Гиббса. Гибридные методы Монте-Карло. Использование методов Монте Карло на примере фильтра частиц.

Использование методов обработки сигналов в задаче множественного трекинга

Задача множественного трекинга лабораторных животных. Определение числа особей в блобе. Алгоритм разделения особей. Идентификация животных и определение ключевых точек.

Часть 3. Методы понижения размерности.

Методы понижения размерности

Метод главных компонент. Вероятностный РСА. Ядровая версия РСА. Анализ независимых компонент. Нелинейное уменьшение размерности. Методы на базе MDL – минимальной длины описания. Активные контура и их применение для сегментации движущихся объектов в видеопотоке. Алгоритмы распознавания лиц на базе методов понижения размерности.

Ликбез: свойства симметричных матриц, положительно определенные матрицы.

Модель активных контуров

Модель активных контуров и примеры ее применения в задачах компьютерного зрения.

Расписание занятий

В 2009 году курс читается по четвергам на факультете ВМиК МГУ, в ауд. 671, начало в 18-00.

| Дата | Занятие |

|---|---|

| 10 сентября 2009 | Лекция 1 |

| 17 сентября 2009 | Лекция 2 |

| 24 сентября 2009 | Лекция 3 |

| 1 октября 2009 | Лекция 4 |

| 8 октября 2009 | Лекция 5 |

| 15 октября 2009 | Лекция 6 |

| 22 октября 2009 | Лекция 7 |

| 29 октября 2009 | Лекция 8 |

| 5 ноября 2009 | Лекция 9 |

| 12 ноября 2009 | Лекция 10 |

| 19 ноября 2009 | Лекция 11 |

| 26 ноября 2009 | Лекция 12 |

| 3 декабря 2009 | Экзамен |