Кривая ошибок

Материал из MachineLearning.

м |

(→Описание алгоритма) |

||

| Строка 48: | Строка 48: | ||

2. Упорядочим выборку <tex>X^l</tex> по убыванию значения <tex>f(x_i,w)</tex>; | 2. Упорядочим выборку <tex>X^l</tex> по убыванию значения <tex>f(x_i,w)</tex>; | ||

3. Начальная точка кривой — <tex>(FPR_0,TPR_0):=(0,0)</tex>; | 3. Начальная точка кривой — <tex>(FPR_0,TPR_0):=(0,0)</tex>; | ||

| - | 4. | + | 4. Повторять для всех <tex> i= \overline{1,l} </tex>: |

Если <tex>(y_i = -1)</tex>, то сместиться вправо: | Если <tex>(y_i = -1)</tex>, то сместиться вправо: | ||

<tex>FPR_i:= FPR_{i-1} + \frac{1}{l_-}, \ TPR_i:= TPR_{i-1}</tex>; | <tex>FPR_i:= FPR_{i-1} + \frac{1}{l_-}, \ TPR_i:= TPR_{i-1}</tex>; | ||

Версия 16:02, 7 января 2010

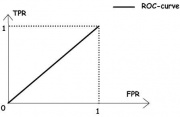

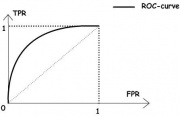

Кривая ошибок или ROC-кривая – часто применяемый способ представления характеристик качества бинарного классификатора.

Содержание |

Кривая ошибок в задаче классификации

Рассмотрим задачу логистической регрессии в случае двух классов. Традиционно, один из этих классов будем называть классом «с положительными исходами», другой - «с отрицательными исходами» и обозначим множество классов через . Рассмотрим линейный классификатор для указанной задачи:

.

Параметр полагается равным

, где

– штраф за ошибку на объекте класса

,

. Эти параметры выбираются из эмперических соображений и зависят от задачи.

Нетрудно заметить, что в задаче существенны не сами параметры , а их отношение:

.

RoC-кривая является распространённым способом оценки качества алгоритма, вне зависимости от выбора цен ошибок.

TPR и FPR

Рассмотрим два следующих функционала:

1. False Positive Rate доля объектов выборки ошибочно отнесённых алгоритмом

к классу {+1}:

2. True Positive Rate доля объектов выборки правильно отнесённых алгоритмом

к классу {+1}:

Подробнее об этих функционалах можно прочесть здесь.

ROC-кривая показывает зависимость количества верно классифицированных положительных объектов из (по оси Y) от количества неверно классифицированных отрицательных объектов из

(по оси X).

Алгоритм построения RoC-кривой

На основе обучающей выборки можно очень эффективно аппроксимировать RoC-кривую для заданного классификатора. Ниже приведён алгоритм, строящий эту зависимость.

Входные данные

- Обучающая выборка

-

— вероятность того, что

принадлежит классу {+1}.

Результат

— последовательность из

точек на координатной плоскости из области

, аппроксимирующая RoC-кривую по обучающей выборке

.

Описание алгоритма

1. Вычислим количество представителей классов {+1} и {-1} в обучающей выборке:

![l_-:= \sum_{i=1}^l [y_i= -1], \ l_+:= \sum_{i=1}^l [y_i= +1]](../mimetex/?l_-:= \sum_{i=1}^l [y_i= -1], \ l_+:= \sum_{i=1}^l [y_i= +1] ) ;

2. Упорядочим выборку

;

2. Упорядочим выборку  по убыванию значения

по убыванию значения ) ;

3. Начальная точка кривой —

;

3. Начальная точка кривой — :=(0,0)) ;

4. Повторять для всех

;

4. Повторять для всех  :

Если

:

Если ) , то сместиться вправо:

, то сместиться вправо:

;

иначе сместиться вверх:

;

иначе сместиться вверх:

;

;

Функционал качества

В качестве функционала качества, инвариантного относительно выбора цен ошибок, используют площадь под RoC-кривой. Эту величину также называют AUC (Area Under Curve). Чем больше значение AUC, тем «лучше» алгоритм.

См. также

Ссылки

| | Данная статья является непроверенным учебным заданием.

До указанного срока статья не должна редактироваться другими участниками проекта MachineLearning.ru. По его окончании любой участник вправе исправить данную статью по своему усмотрению и удалить данное предупреждение, выводимое с помощью шаблона {{Задание}}. См. также методические указания по использованию Ресурса MachineLearning.ru в учебном процессе. |