Структурные методы анализа изображений и сигналов (курс лекций, А.С. Конушин, Д.П. Ветров, Д.А. Кропотов, О.В. Баринова, В.С. Конушин, 2009)

Материал из MachineLearning.

(+ ссылки на видео-лекцию по теме "СММ, часть 2") |

(Уточнение программы лекций) |

||

| Строка 133: | Строка 133: | ||

|19 ноября 2009||Лекция 11 «Методы Монте-Карло с марковскими цепями. Фильтр частиц.» | |19 ноября 2009||Лекция 11 «Методы Монте-Карло с марковскими цепями. Фильтр частиц.» | ||

|- | |- | ||

| - | |26 ноября 2009||Лекция 12 | + | |26 ноября 2009||Лекция 12 «Практический пример: задача множественного трекинга лабораторных животных» |

|- | |- | ||

| - | |3 декабря 2009||Лекция 13 | + | |3 декабря 2009||Лекция 13 «Методы понижения размерности» |

|- | |- | ||

| - | |10 декабря 2009|| | + | |10 декабря 2009||Обзор курса. Консультация перед экзаменом. |

|- | |- | ||

| + | |17 декабря 2009||Экзамен | ||

|} | |} | ||

Версия 14:16, 13 ноября 2009

| | Внимание! Выложено второе задание по курсу. Срок сдачи — 15 ноября. — Д.А. Кропотов 02:41, 31 октября 2009 (MSK) |

| | Студентам на заметку: на вкладке «Обсуждение» к данной странице можно задать вопрос по курсу, высказать свои пожелания, предложения и т.п.

Д.А. Кропотов, 20 сентября 2009 |

Курс посвящен математическим методам обработки информации, основанных на выделении структуры в исходных данных и ее последующем анализе. Эти методы широко используются при решении задач из разных прикладных областей, включая обработку изображений и видео, анализ поведения, распознавание речи, машинное обучение.

Краткая презентация о курсе (PDF, 532 Кб)

Программа курса

Часть 1. Графические модели для анализа изображений.

Введение в курс и понятие графических моделей.

Обзор курса. Задачи анализа структурированных данных. Представление зависимостей между объектами в виде графов. Основные задачи, для решения которых используются графические модели. Демонстрация современных работ, опирающихся на данные в курсе методы.

Напоминание основных понятий, которые будут активно использоваться в следующих лекциях. Основные операции с вероятностями (правило суммы, произведения, формула Байеса). Понятия мат. ожидание и матрицы ковариаций. Нормальное распределение. Независимость событий. Маргинализация (исключение переменной). Метод максимального правдоподобия, МАР-оценивание на примере нормального распределения. Матричная нотация (скалярное произведение, следы матриц, квадратичные формы, дифференцирование по вектору). Правило множителей Лагранжа с ограничениями в виде равенств и неравенств.

Основные графические модели

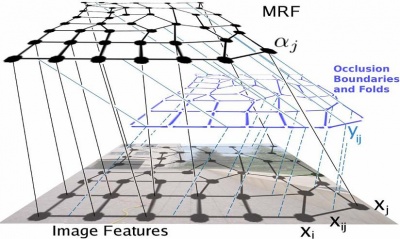

Байесовские сети. Элементарные способы работы с байесовскими сетями. Марковские сети. Потенциалы на кликах. Примеры использования марковских сетей для анализа изображений. Ликбез: независимость случайных событий. Условная вероятность. Условная независимость.

Марковские сети и дискретная оптимизация

Энергетическая формулировка задач компьютерного зрения. Разрезы графов, алгоритмы нахождения максимального потока. Интерактивная сегментация изображений. Энергия, которую можно минимизировать с помощью разрезов графов. Многоуровневые разрезы графов. Приближенная минимизация энергии с помощью разрезов графов. Алгоритм, основанный на замене. Примеры минимизируемых энергий. Сегментация видео. Сшивка изображений. Трехмерная реконструкция.

Презентация с тьюториала на Графиконе 2009 по разрезам графов

Методы настройки марковских случайных полей

Методы обучения в марковских случайных полях. Применение для семантической сегментации изображений, распознавания объектов с учетом контекста и трехмерной реконструкции.

Алгоритмы обмена сообщениями. Belief propagation и Loopy belief propagation.

Приближенные методы вывода в графических моделях

Алгоритмы обмена сообщениями на графах. Алгоритмы Belief Propagation и Tree-ReWeighted Belief Propagation.

Презентация лекции Владимира Колмогорова (PDF, 209 Кб)

Расширения разрезов графов для сегментации изображений

Расширения разрезов графов для сегментации изображений. Branch-and-Mincut. Bounding box prior for interactive segmentation.

Презентация лекции Виктора Лемпицкого (PDF, 5.58 Мб)

Часть 2. Графические модели для анализа и распознавания сигналов.

Скрытые марковские модели. Алгоритм сегментации сигнала

Примеры задач сегментации сигналов. Обучение НММ с учителем. Поиск наиболее вероятной последовательности состояний. ЕМ-алгоритм и его использование в анализе графических моделей.

Обучение СММ без учителя

Алгоритм Баума-Уэлша для подсчета условного распределения скрытой переменной в отдельной точке. ЕМ-алгоритм для обучения НММ без учителя. Особенности численной реализации на ЭВМ. Модификации НММ (НММ высших порядков, факториальные НММ, многопоточные НММ, НММ ввода-вывода). Примеры использования НММ.

Видео-лекция (часть 1) Видео-лекция (часть 2)

Методы фильтрации данных

Линейные динамические системы, фильтр Калмана. Настройка параметров фильтра Калмана. Уравнения Рауса-Тунга-Штрибеля. Пример использования.

Методы Монте Карло с марковскими цепями

Взятие интегралов методами Монте-Карло, голосование по апостериорному распределению вместо точечного решающего правила. Схема Гиббса. Гибридные методы Монте-Карло. Использование методов Монте Карло на примере фильтра частиц.

Использование методов обработки сигналов в задаче множественного трекинга

Задача множественного трекинга лабораторных животных. Определение числа особей в блобе. Алгоритм разделения особей. Идентификация животных и определение ключевых точек.

Часть 3. Методы понижения размерности.

Методы понижения размерности

Метод главных компонент. Вероятностный РСА. Ядровая версия РСА. Анализ независимых компонент. Нелинейное уменьшение размерности. Методы на базе MDL – минимальной длины описания. Активные контура и их применение для сегментации движущихся объектов в видеопотоке. Алгоритмы распознавания лиц на базе методов понижения размерности.

Ликбез: свойства симметричных матриц, положительно определенные матрицы.

Модель активных контуров

Модель активных контуров и примеры ее применения в задачах компьютерного зрения.

Расписание занятий

В 2009 году курс читается по четвергам на факультете ВМиК МГУ, в ауд. 671, начало в 18-05.

| Дата | Занятие |

|---|---|

| 10 сентября 2009 | Лекция 1 «Введение в курс. Напоминание известных математических фактов для последующих лекций» |

| 17 сентября 2009 | Лекция 2 «Графические модели. Общее представление» |

| 24 сентября 2009 | Лекция 3 «Минимизация энергии с помощью разрезов графов» |

| 1 октября 2009 | Лекция 4 «Алгоритмы обмена сообщениями. Методы настройки потенциалов случайных полей» |

| 8 октября 2009 | Лекция 5 «Алгоритмы обмена сообщениями в циклических графах. Tree-reweighted message passing» |

| 15 октября 2009 | Лекция 6 «Расширения разрезов графов для сегментации изображений. Branch-and-Mincut. Bounding box prior for interactive segmentation» |

| 22 октября 2009 | Лекция 7 «Скрытые марковские модели. Обучение с учителем. ЕМ-алгоритм.» |

| 29 октября 2009 | Лекция 8 «Скрытые марковские модели. Обучение без учителя.» |

| 5 ноября 2009 | Лекция 9 «Модель активных контуров и примеры ее применения в задачах компьютерного зрения.» |

| 12 ноября 2009 | Лекция 10 «Линейные динамические системы. Фильтр Калмана.» |

| 19 ноября 2009 | Лекция 11 «Методы Монте-Карло с марковскими цепями. Фильтр частиц.» |

| 26 ноября 2009 | Лекция 12 «Практический пример: задача множественного трекинга лабораторных животных» |

| 3 декабря 2009 | Лекция 13 «Методы понижения размерности» |

| 10 декабря 2009 | Обзор курса. Консультация перед экзаменом. |

| 17 декабря 2009 | Экзамен |

Практические задания по курсу

Для успешной сдачи спецкурса необходимо выполнить все практические задания, а также сдать экзамен. Выполненные практические задания следует загружать сюда. Там же будут доступны результаты проверки заданий.

Задание 1. Минимизация энергии с помощью разрезов графа. Описание задания доступно здесь.

Задание 2. Скрытые марковские модели.

Оценка за курс

В этом году оценка за курс будет вычисляться по формуле 0.25*(оценка за первое задание)+0.25*(оценка за второе задание)+0.5*(оценка за экзамен). При этом оценка за курс будет выставляться только тем, кто успешно справился с обоими практическими заданиями + сдал экзамен.

| Участник | Группа | Задание 1 | Задание 2 | Экзамен | Итоговая оценка | |

|---|---|---|---|---|---|---|

| Вариант | Оценка | |||||

| Новиков Павел Александрович | 203 | 5.0 | 3 | |||

| Дударенко Марина Алексеевна | 317 | 5.0 | 1 | |||

| Тихонов Андрей Александрович | 317 | 2 | ||||

| Ермишин Федор Дмитриевич | 321 | 4.5 | 2 | |||

| Кухаренко Артем Игоревич | 321 | 5.5 | 3 | |||

| Воронов Александр Александрович | 421 | 5.0 | 1 | |||

| Лукина Татьяна Михайловна | 421 | 4.5 | 2 | |||

| Потапов Дмитрий Борисович | 421 | 4.5 | 3 | |||

| Третьяк Елена Викторовна | 421 | 4.5 | 1 | |||

| Блажевич Ксения Игоревна | 422 | 5.0 | 2 | |||

| Ломакин Василий Дмитриевич | 517 | 5.5 | 3 | |||

| Одинокова Евгения Андреевна | 517 | 5.0 | 2 | |||

| Юданов Анатолий Александрович | 525 | 5.0 | 1 | |||

Литература

- Bishop C.M. Pattern Recognition and Machine Learning. Springer, 2006.

- Mackay D.J.C. Information Theory, Inference, and Learning Algorithms. Cambridge University Press, 2003.

- Jordan M.I. (Ed.) Learning in graphical models. Cambridge MA: MIT Press, 1999

- Cowell R.G., Dawid A.P., Lauritzen S.L., Spiegelhalter D.J. Probabilistic networks and expert systems. Berlin: Springer, 1999.

См. также

Страница курса на сайте лаборатории компьютерной графики и мультимедиа ВМиК МГУ

Курс «Байесовские методы машинного обучения»