Непараметрическая регрессия

Материал из MachineLearning.

Непараметрическая регрессия, в отличие от параметрических подходов, использует модель, которая не описывается конечным числом параметров.

Содержание |

Введение

- Цель регрессионного анализа состоит в осуществлении разумной аппроксимации неизвестной функции отклика

по известым точкам

. В случае малых ошибок наблюдения становится возможным сконцентрировать внимание на важных деталях средней зависимости

от

при ее интерпретации.

Отличие от параметрических подходов

- Процедура аппроксимации обычно называется сглаживанием. По существу эта аппроксимация функции отклика

может быть выполнена двумя способами. Довольно часто используется параметрический подход, заключающийся в предположении, что функция отклика

имеет некоторую предписанную функциональную форму, например, это прямая линия с неизвестными свободным членом и наклоном. Альтернативой этому может служить попытка оценить

непараметрически, без указания конкретного ее вида. Первый подход к анализу регрессионной зависимости называется параметрическим, поскольку предполагается, что вид функции полностью описывается конечным набором параметров. Типичный пример параметрической модели представляет собой полиномиальное уравнение регрессии, когда параметрами являются коэффициенты при неизвестных. Однако при параметрическом подходе молчаливо предполагается, что кривая может быть представлена в терминах параметрической модели, или, по крайней мере, имеется уверенность в том, что ошибка аппроксимации для наилучшего параметрического приближения пренебрежимо мала. Наоборот, в непараметрической модели регрессионной зависимости не производится проектирования данных в "прокрустово ложе" фиксированной параметризации. Предварительное задание параметрической модели может оказаться слишком ограничительным или чересчур малой размерности для аппроксимации непредвиденных характеристик, в то время как непараметрическое сглаживание предоставляет гибкие средства анализа неизвестных регрессионных зависимостей.

- Непараметрический подход приводит, таким образом, к гибкому функциональному виду кривой регрессии.

Разновидности

Ядерное сглаживание

- Одним из простейших методов является ядерное сглаживание. Этот метод прост в применении, не требует дополнительных математических сведений и понятен на интуитивном уровне. Ядерное сглаживание во многих случаях является подходящим средством. Существуют разнообразные альтернативные методы сглаживания такие, например, как сплайны, но в [Хардле В, гл3] показывается, что в асимптотическом смысле они эквивалентны ядерному сглаживанию.

- Ключом к проведению качественного непараметрического оценивания является выбор подходящей ширины окна для имеющейся задачи. Хотя ядерная функция

остается важной, ее главная роль состоит в обеспечении дифференцируемости и гладкости получающейся оценки. Ширина окна

, с другой стороны, определяет поведение оценки в конечных выборках, что ядерная функция сделать просто не в состоянии. Существуют четыре общих подхода к выбору ширины окна:

- референтные эвристические правила

- методы подстановки

- методы кросс-валидации

- бутстраповские методы.

Ради аккуратности подчеркнем, что диктуемые данными методы выбора ширины окна не всегда гарантируют хороший результат.

- Исходя из минимизации глобальной ошибки следует

брать равным::

, где

- неизвестная аппроксимируемая зависимость.

Референтные эвристические правила

- Референтные эвристические правила выбора ширины окна используют стандартное семейство распределений для определения

.

Рассмотрим оценку Парзена-Розенблата для одномерной функции плотности

-

.

-

- В случае семейства ормальных рапределений и гаусовского ядра

. На практике применяется

, выборочное стандартное отклонение.

Методы подстановки

Методы подстановки, такие как в Sheather & Jones (1991), состоят в подстановке оценок неизвестной константы в формулу для оптимальной ширины окна на основе первоначальной оценки

, которая в свою очередь основана на «предварительной» ширине окна, например, найденной по правилу

. Все прочие константы в выражении для

известны после выбора ядерной функции

(то есть

и

известны). Хотя такие правила популярны, заинтересованный читатель может обратиться к работе , где обсуждаются относительные достоинства методов подстановки по сравнению с другими методами выбора ширины окна, обсуждаемыми ниже. Подробнее см Loader (1999).

Методы кросс-валидации

- Методы кросс-валидация на основе наименьших квадратов – это полностью автоматический и диктуемый данными метод выбора сглаживающего параметра. Этот метод основан на принципе выбора ширины окна, минимизирующей интегральную среднеквадратическую ошибку получающейся оценки. Интеграл квадрата разности

и

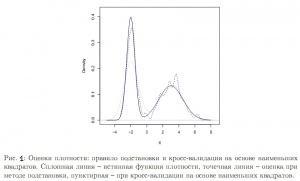

имеет вид

- Можно заменить эти величины их выборочными аналогами, сделать поправку на смещение и получить целевую функцию, которую затем можно минимизировать с помощью численных методов. Этот подход был предложен в работах Rudemo (1982) и Bowman (1984). Для понимания сущности комментариев Loader (1999) в на Рис. 1 изображены оценки бимодальной плотности – ядерная оценка при применении правила подстановки и кросс-валидации на основе наименьших квадратов. Рис. 1 показывает, что на самом деле правило подстановки чрезмерно сглаживает, приводя к существенному смещению в левой вершине. Кросс-валидация на основе наименьших квадратов исправляет это, как отмечает Loader (1999), но ценой дополнительной вариации в правой вершине.

- Одна из проблем данного подхода – его чувствительность к наличию округленных или дискретизированных данных, а также к мелкомасштабным эффектам в данных.

- Из примера следует, что, возможно, ядерную оценку с фиксированным параметром h можно улучшить, и существуют «адаптивные» ядерные оценки, которые позволяют h меняться в точке

или

; см. Abramson (1982) и Breiman, Meisel & Purcell (1977). Эти оценки, однако, способствуют введению ложного шума в оценку плотности. Однако метод с фиксированным h доминирует в прикладных исследованиях.

Бутстраповские методы

Faraway & Jhun (1990) предложили метод выбора ширины окна h на основе бутстрапа путем оценивания глобальной ошибки для каждой фиксированной ширины окна и затем минимизации по всем значениям. Данный подход использует сглаженный бутстраповский метод на основе начальной оценки плотности. Один из недостатков этого подхода в том, что целевая функция является случайной, что может привести к проблемам при численной минимизации, а также его вычислительная сложность.

Ядерное сглаживание

Литература

- Хардле В. Прикладная непараметрическая регрессия. — 1989.

Ссылки

- Loader, C.R. Bandwidth selection: Classical or plug-in? Annals of Statistics 27. — 1999. — С. 415–438.

- Sheather, S., M. Jones A reliable data-based bandwidth selection method for kernel density estimation. Journal of Royal Statistical Society, Series B 53. — 1991. — С. 683–690.