Выбор признаков с помощью генетических алгоритмов (пример)

Материал из MachineLearning.

(→Результаты на модельных данных) |

(→Результаты на модельных данных) |

||

| Строка 35: | Строка 35: | ||

Использовался следующий набор порождающих функций ( всего 12 ): <br /> | Использовался следующий набор порождающих функций ( всего 12 ): <br /> | ||

<tex>1,\; x,\; x^2,\; log(x),\; x^3,\; x*log(x),\; x^4,\; x^2*log(x),\; x^2*cos(x),\; cos(x)*log(x),\; x*sin(x)*log(x),\; x^2*cos(x)*log(x).</tex> <br /> | <tex>1,\; x,\; x^2,\; log(x),\; x^3,\; x*log(x),\; x^4,\; x^2*log(x),\; x^2*cos(x),\; cos(x)*log(x),\; x*sin(x)*log(x),\; x^2*cos(x)*log(x).</tex> <br /> | ||

| - | В наборе не было следующих функций, участвовавших в порождении: <tex>sin(x),\; x^2*sin(x)</tex> | + | В наборе не было следующих функций, участвовавших в порождении: <tex>sin(x),\; x^2*sin(x).</tex> |

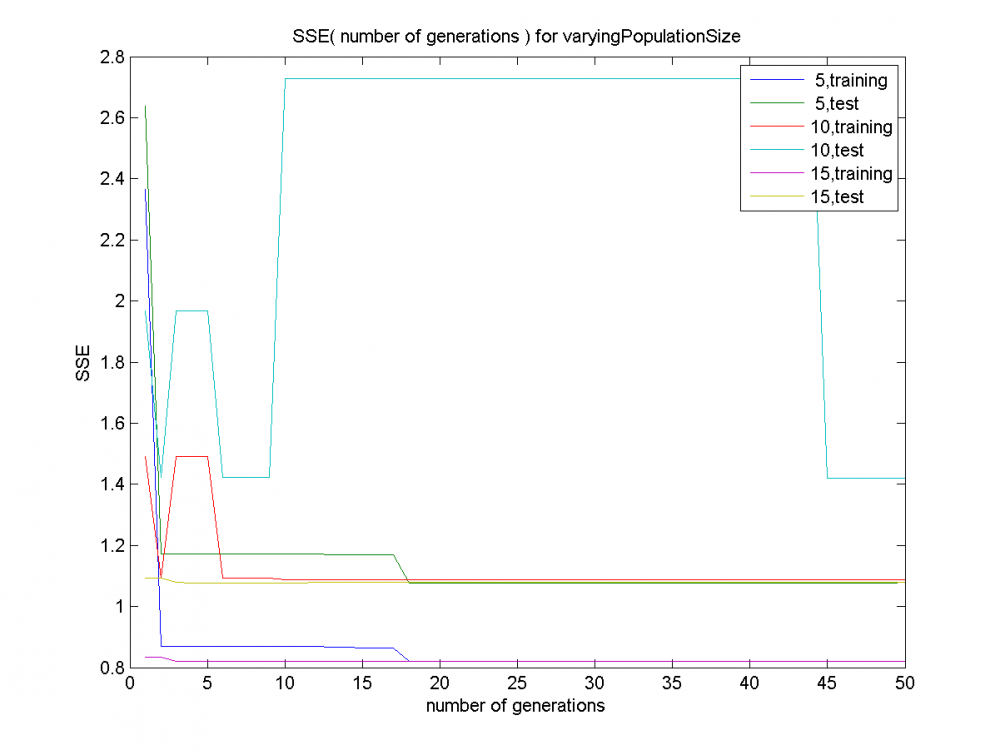

[[Изображение:SSE( number of generations ) for varyingPopulationSize.png|1000px]] <br /> | [[Изображение:SSE( number of generations ) for varyingPopulationSize.png|1000px]] <br /> | ||

График training,5 демонстрирует раннюю сходимость. Графики 10 демонстрируют раннюю сходимость + переобучение. Графики 15 показывают сходимость без переобучения. <br /> | График training,5 демонстрирует раннюю сходимость. Графики 10 демонстрируют раннюю сходимость + переобучение. Графики 15 показывают сходимость без переобучения. <br /> | ||

Версия 17:43, 28 апреля 2010

|

Генетический алгоритм — эвристический алгоритм поиска, используется для решения задач оптимизации. Название обусловлено смыслом эвристики: моделируется биологический естественный отбор, степень приспособленности определяется значением целевой функции. Возможно применение генетического алгоритма для выбора признаков линейной регрессии, поскольку данная задача допускает оптимизационную формулировку (если множество порождающих функций зафиксировано).

Постановка задачи

Задана выборка — множество значений свободных

переменных и множество

соответствующих им значений зависимой переменной.

Задано множество порождающих функций линейной регрессионной модели

, где

. Введем обозначения:

,

, k = ||c||1, { ij }j=1k⊂{ 1,...,N } : c( ij )=1 при j=1,...,k;

Требуется решить следующую задачу:

Описание алгоритма

Свободные параметры: размер популяции, доля кроссоверинга ( доля особей одного поколения, подвергающихся кроссоверингу ).

- Инициализация( создание начальной популяции необходимого размера ). Хромосомы особей представляют собой битовые векторы со случайными компонентами. Счетчик числа итераций: n=0.

- n:=n+1. Проверка условий завершения: либо n превысило максимально допустимое значение, либо изменения целевой функции SSE для лучшей особи в популяции за некоторое число итераций оказалось слишком малым.

- Селекция( выбор особей для следующего поколения ). Селекция выполняется на основе оценки SSE всех особей. Используемый механизм таков: на единичном отрезке каждой особи выделяется участок, длина которого пропорциональна SSE. Далее алгоритм-селектор движется вдоль отрезка с фиксированным шагом, выбирая каждый раз ту особь, над которой находится. Начальная точка выбирается случайно, при этом начальное расстояние до левого конца должно быть меньше шага.

- Кроссоверинг. Выбирается число особей, равное доли кроссоверинга * размер популяции. С парами особей выполняется так называемый кроссоверинг с маской( см. Оператор скрещивания ). В результате этой операции каждая аллель ( т. е. позиция в хромосоме особи ) случайным образом заполняется геном 1-ого или 2-ого родителя.

- Мутация. Для каждой особи в каждой аллели с вероятностью 0.01 происходит мутация, которая выражается в замене текущего гена на 0 или 1 случайным образом( равновероятно ).

- Возвращение на шаг 2.

Вычислительный эксперимент

Показана работа алгоритма на реальных и модельных данных.

Модельные данные

Данные порождались следующим образом:

x = [ 1:0.5:20 ]'; y = x + x.^2 + sin( x ) + log( x ) + x.*log( x ) + ( x.^2 ).*sin( x ) + randn( size( x, 1 ), 1 );

Выборка делилась на training и testing части в соотношении 60%:40% случайным образом. Исследовались 2 эффекта: ложная ( ранняя ) сходимость и переобучение.

Результаты на модельных данных

Использовался следующий набор порождающих функций ( всего 12 ):

В наборе не было следующих функций, участвовавших в порождении:

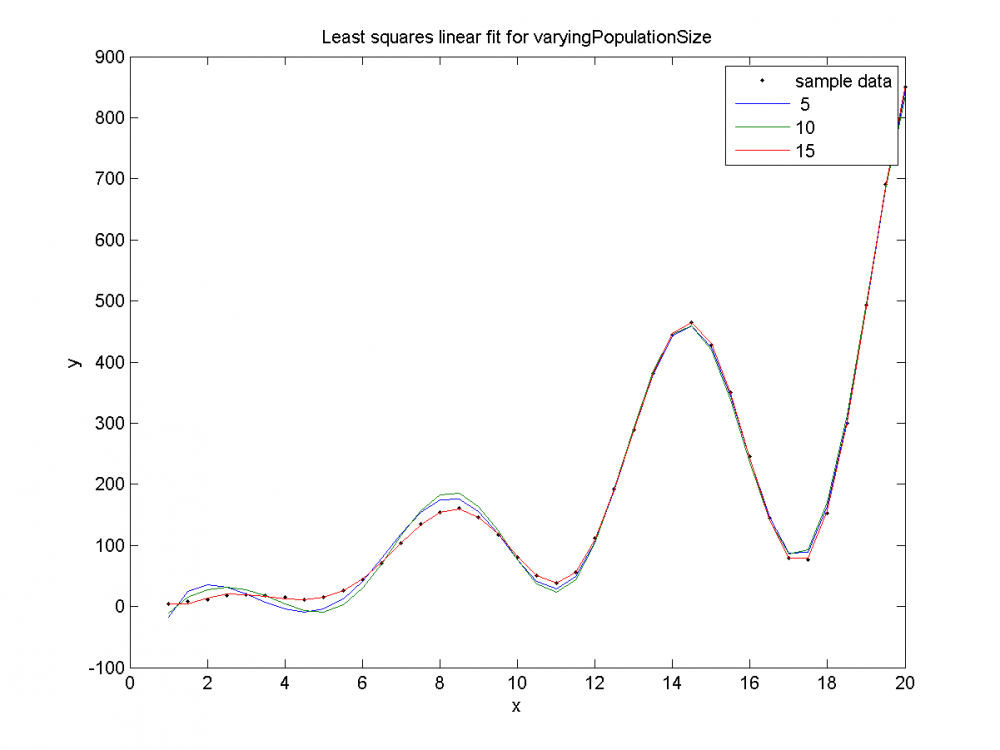

График training,5 демонстрирует раннюю сходимость. Графики 10 демонстрируют раннюю сходимость + переобучение. Графики 15 показывают сходимость без переобучения.

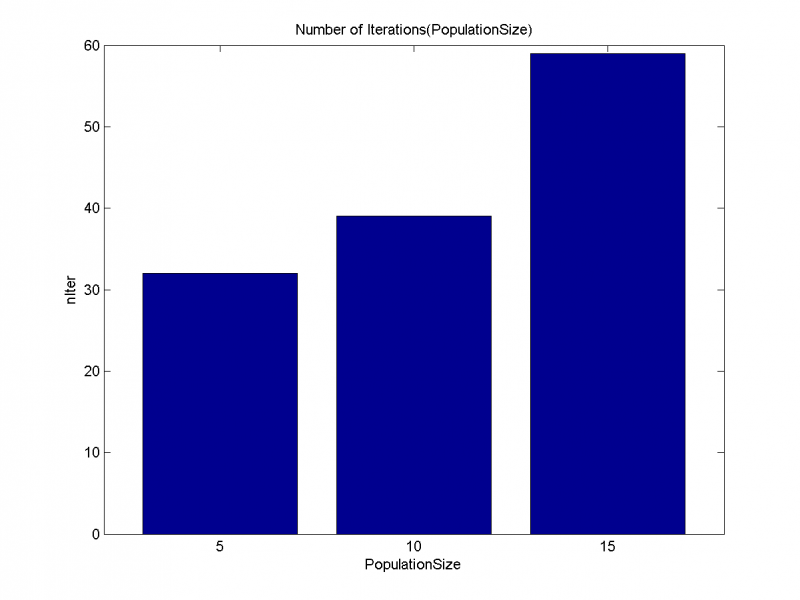

Подтверждение ранней сходимости для случаев 5, 10. Дольше всех работает 15.

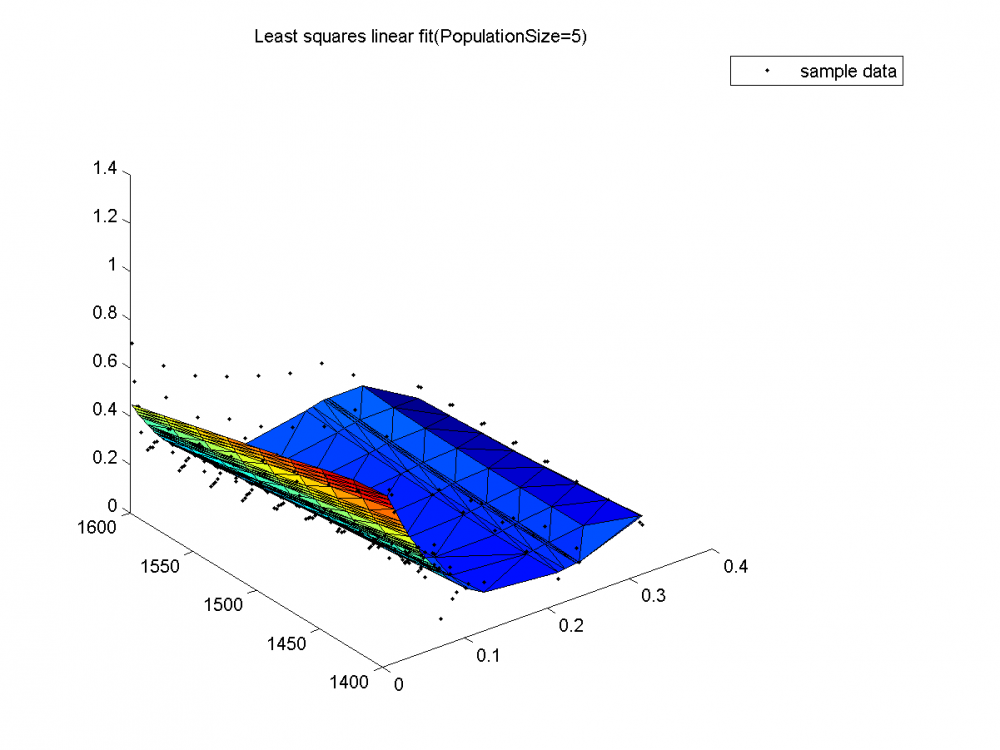

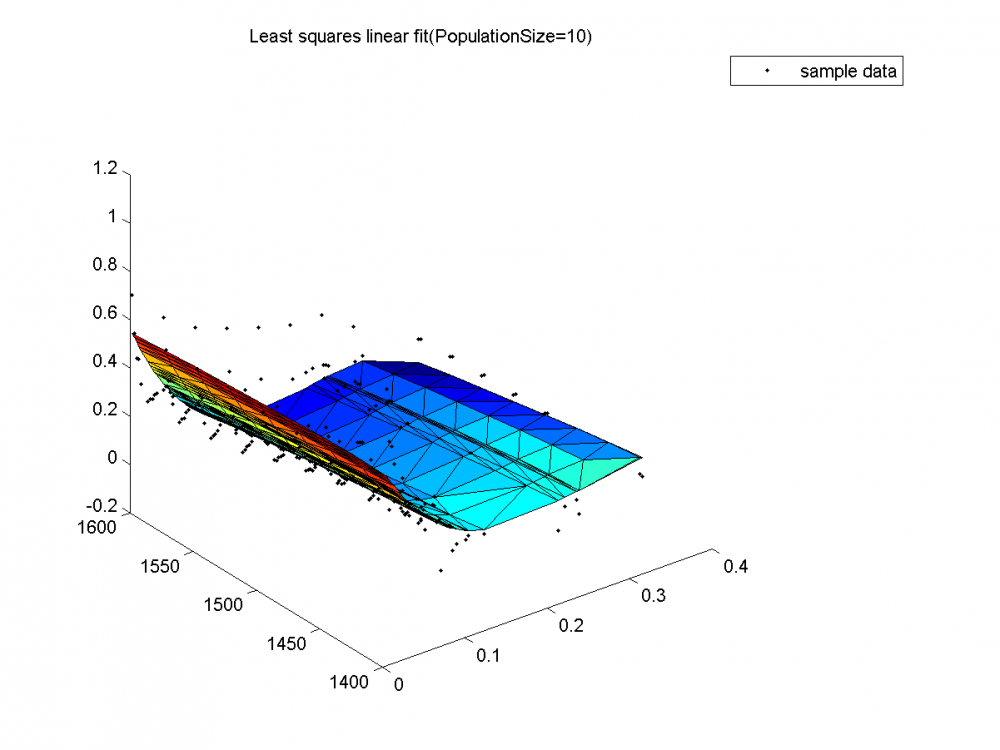

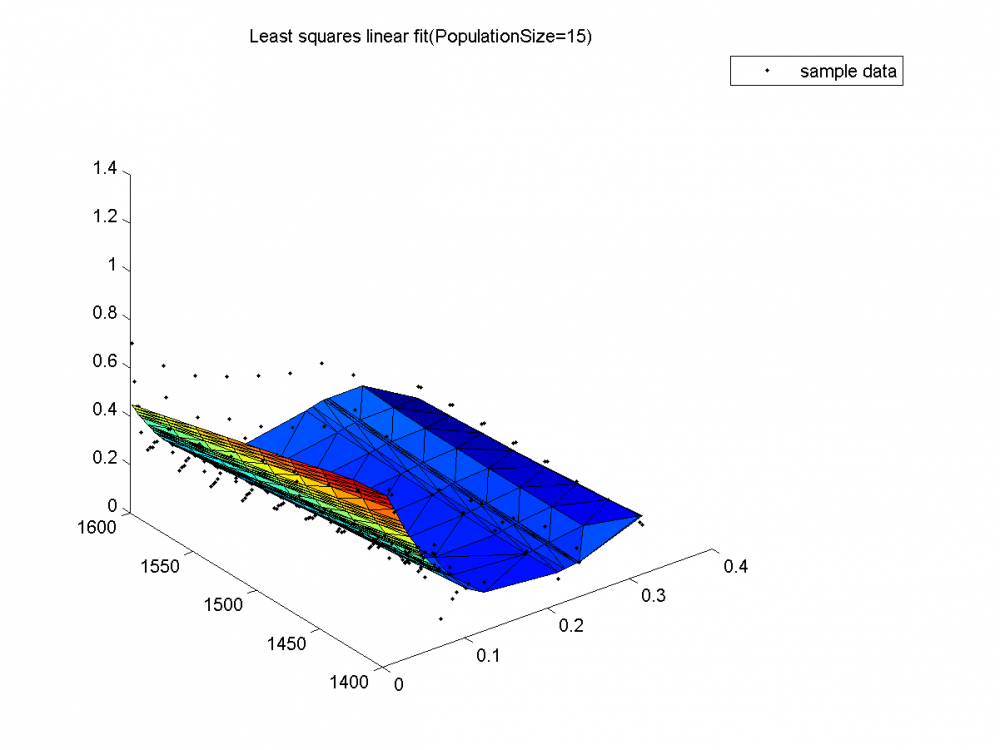

Наглядная демонстрация ранней сходимости и переобучения. В случаях 5, 10 выборка хорошо приближена на training-части, а на test-части наблюдаются сильные отклонения. Для случая 15 - подтверждается отсутствие ранней сходимости, переобучения.

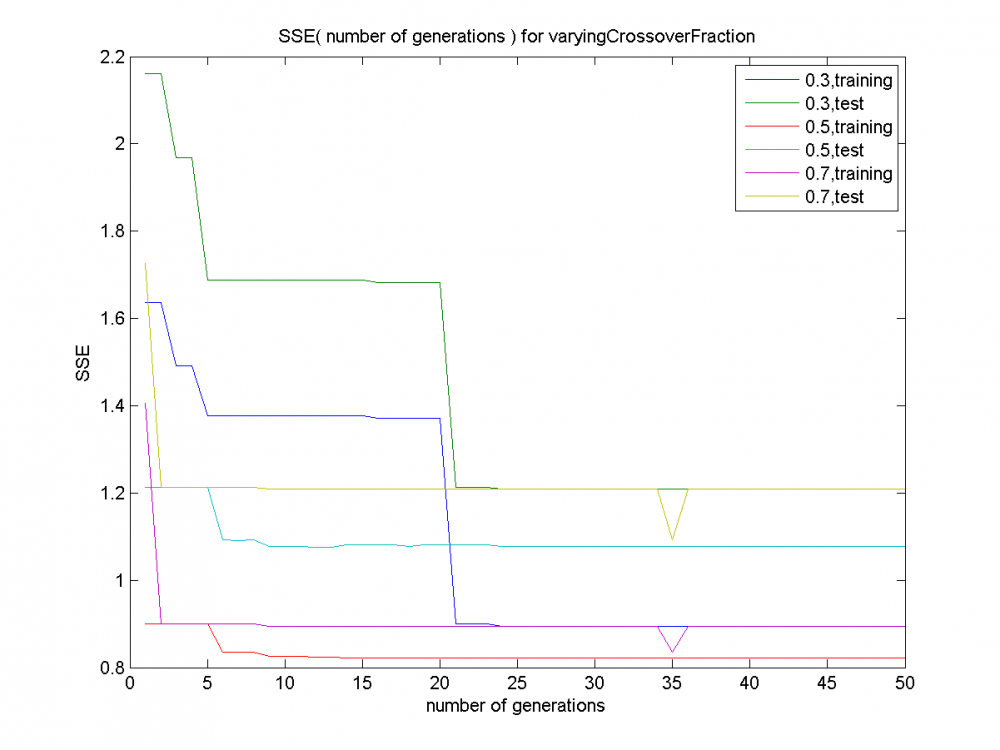

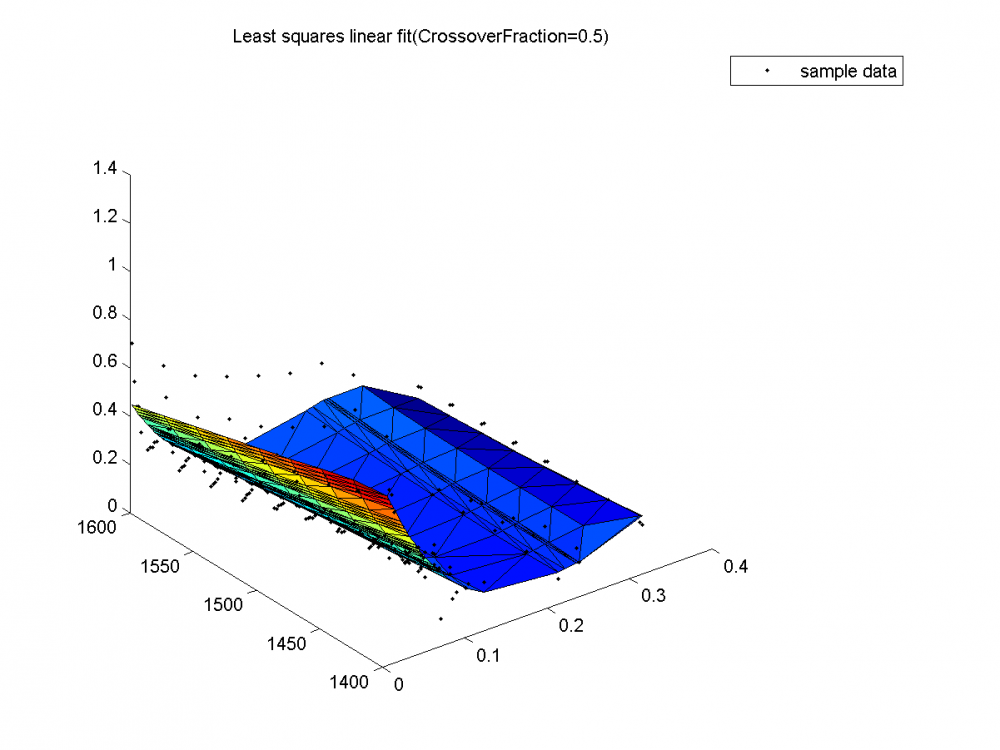

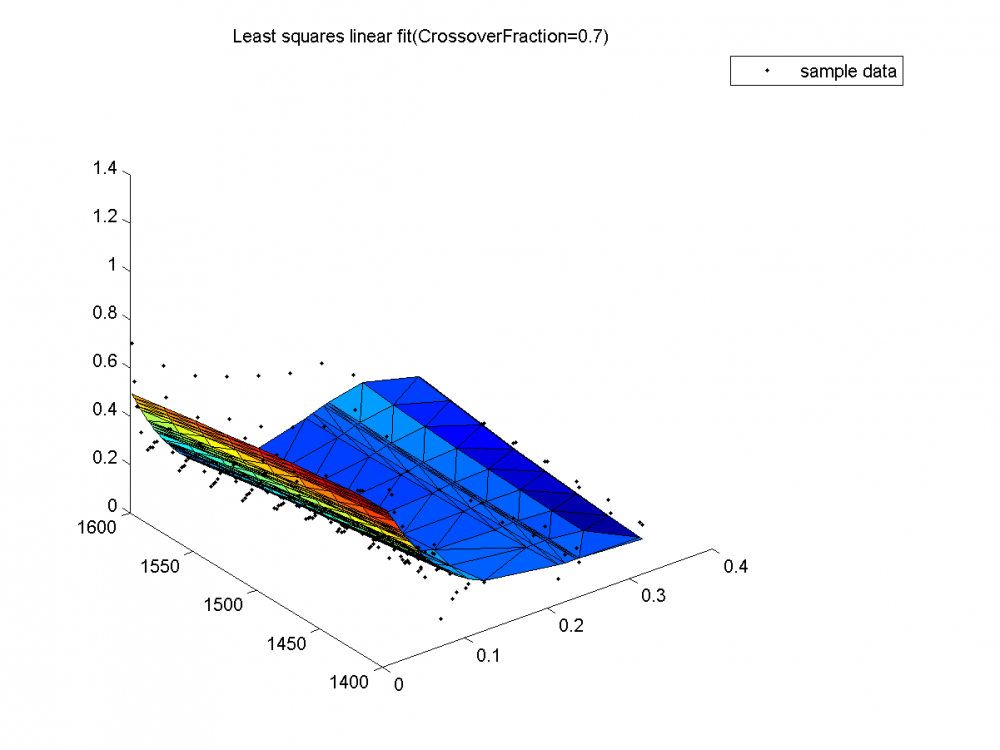

Случаи 0.3, 0.7 характеризуются явным переобучением. Для случая 0.5 переобучение не наблюдается, только незначительная ранняя сходимость.

Наглядная демонстрация переобучения для случаев 0.3, 0.7. В случае 0.5 нет явного переобучения, как уже было замечено ранее.

Выводы

Чем больше размер популяции, тем менее вероятно переобучение и ранняя сходимость. Оптимальное значение доли кроссоверинга равно 0.5.

Реальные данные

Выборка с улыбкой волатильности. 2 независимые переменные: время и страйк, зависимая переменная - волатильность. Выборка делилась как и прежде.

Результаты на реальных данных

Использовался следующий набор порождающих функций ( всего 21 ):

Случай 10 явно демонстрирует переобучение. Самый лучший результат - в случае 15.

Нормальный результат, но это скорее случайность. График SSE показал, что алгоритм почти сразу случайно попал в минимум.

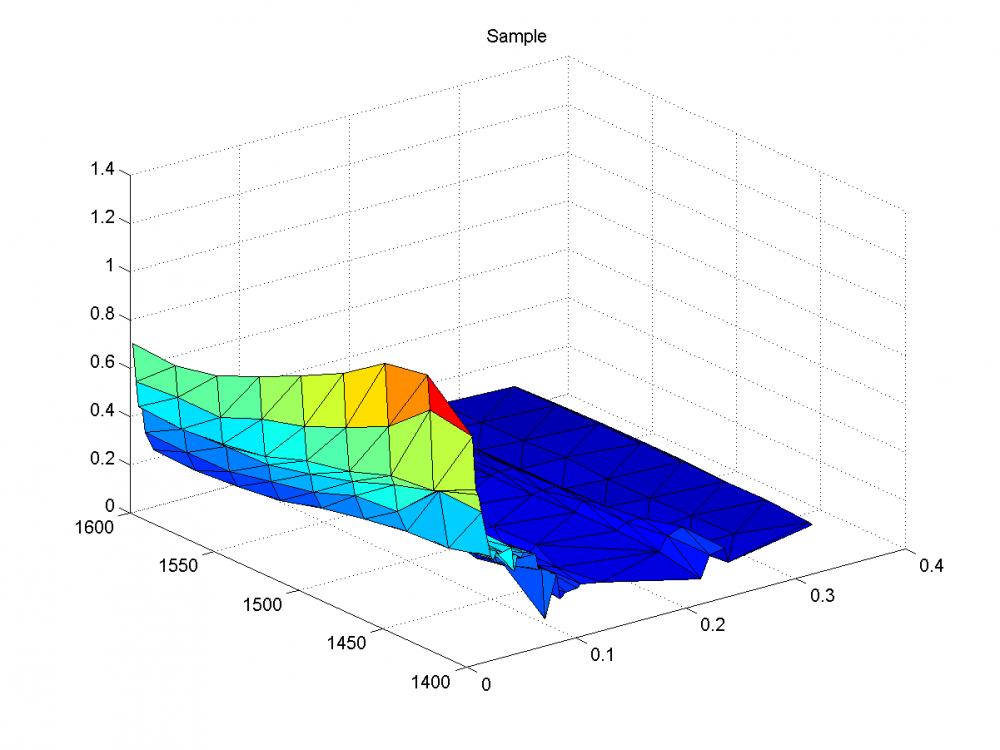

Переобучение: красный правый угол поверхности "загнут" не в ту сторону.

Самый лучший результат.

Четко видно, что лучший результат достигается при значении параметра = 0.5. В остальных случаях алгоритм попадает в локальный минимум, далекий от оптимального решения.

Ранняя сходимость: правый красный конец недостаточно загнул, левый синий - слишком.

Лучший результат.

Ранняя сходимость, ситуация аналогична 0.3.

Выводы

Подтверждаются выводы, сделанные для модельных данных.

Исходный код

Скачать код MATLAB можно здесь: createArtificialData1D.m,

testGaEffeciency.m,

gaEffeciency.m,

evalSSE.m,

plotRes.m,

plotRegression.m.

Скачать реальные данные по опционам можно здесь: realOptions2D.txt.

Смотри также

Литература

- Matlab 7.9.0(R2009b), Product Help\Genetic algorith options.

| | Данная статья является непроверенным учебным заданием.

До указанного срока статья не должна редактироваться другими участниками проекта MachineLearning.ru. По его окончании любой участник вправе исправить данную статью по своему усмотрению и удалить данное предупреждение, выводимое с помощью шаблона {{Задание}}. См. также методические указания по использованию Ресурса MachineLearning.ru в учебном процессе. |