Группировка категорий и сегментация признаков в логистической регрессии (пример)

Материал из MachineLearning.

Группировка категорий — метод снижения числа признаков, полученных с помощью бинаризации номинальных шкал в модели логистической регрессии.

Сегментация признака - разбиение множества значений признака на некоторые семейства таким образом, чтобы учесть нелинейные зависимости значений признака в обобщенно - линейной модели.

Содержание |

Постановка задачи

Задана регрессионная модель - логистическая регрессия.

Набор данных:

Целевая переменная:

Модель:

где

Индексы:

- разбиение на обучающую и контрольную выборки.

- индексы признаков.

Требуется:

1) Сегментировать линейные признаки.

2) Категоризовать номинальные признаки.

При этом надо применить как новые алгоритмы, так и классические, приведенные в книге Credit Risk Scorecards: Developing and Implementing Intelligent Credit Scoring. Сравнить оба подхода.

Описание алгоритмов

До выполнения алгоритмов сегментации и категоризации предполагается из начальных данных выбрать набор признаков для построения регрессинной модели. Принято называть такие признаки активными. Для этого решается задача максимизации правдоподобия на контрольной выборке, или эквивалентно - минимизация его логарифма, взятого с противополжным знаком

Здесь под строкой подразумевается строка из условия, но с удаленными координатами, номера которых не входят во множество индексов

. Вектор

соответствующей длины. Текущее множество активных признаков -

. Тогда задача нахождения множества активных признаков и соответствующего им вектора весов записывается в виде

На первом шаге все номинальные признаки считаются активными. Затем используется простой жадный алгоритм, удаляющий на каждом шаге признак, без которого значение правдоподобия на контрольной выборке наиболее оптимально. Вектор весов находится с помощью алгоритма Ньютона - Рафсона. В данном эксперименте считается, что активными должны получится около половины признаков.

Сегментация линейных признаков

Пусть линейный признак принимают значения из отрезка

. Вводится начальное разбиение отрезка

, на

отрезков одинаковой длины

. Строится кусочно - линейная функция

. На каждом шаге алгоритма случайным образом изменяется значение

, где индекс

- случаное число из

. Коэффициенты

при этом всегда изменяются так, чтобы

где

. Для

и построенной

строится признак

: значения нового признака - значение функции в соответствующей точке отрезка

. Если для новой функции

значение

уменьшается, то сохраняется изменение

. Здесь

. Алгоритм заканчивает работу по достижении первого минимума.

Группировка категорий

Пусть номинальный признак принимает значения из множества категорий

. Ему в соответствие ставится множество

такое, что

. Требуется найти такую сюръективную функцию

и соответствующее ей множество

, которая минимизирует функцию

. Здесь

, а

- номинальный признак, принимающий значения из

. В данном случае признаков и категорий достаточно мало, поэтому эффективен полный перебор.

Также предлагается один из классических методов группировки категорий, описанный в книге Credit Risk Scorecards: Developing and Implementing Intelligent Credit Scoring. Для этого сначала для каждого значения номинального признака считается его (Weight of evidence) по формуле:

, где

, например, - отношение числа людей, которым выдали кредит, имевших данное значение номинального признака, к общему числу людей, которым выдали кредит.

- отношение числа людей, которым не выдали кредит, имевших данное значение номинального признака, к общему числу людей, которым не выдали кредит. Теперь пусть некоторый номинальный признак под номером

принимает значения

. Для него нужно рассчитать

(Information Value) по формуле:

. Для признаков с самыми большими значениями

в одну группу объединяются категории с близкими значеними

. При таком подходе важно задать условия близости значений

и количество группируемых категорий.

Вычислительный эксперимент

Показана работа алгоритма на реальных данных.

Описание данных

Используются реальные данные (GERMAN_UIC) о выдаче или не выдаче банком кредитов. Всего приведены 24 признака для 1000 человек и информация о том, выдан ли впоследствии кредит.

Визуализация результатов

На первом шаге из данных выбраны признаки, используемые в дальнейшем в регрессионной модели.

Затем выбирается некоторый линейный признак.

Примеры сегментации линейных признаков

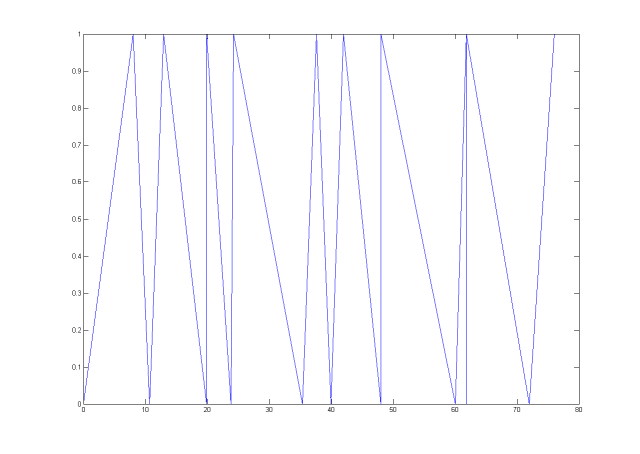

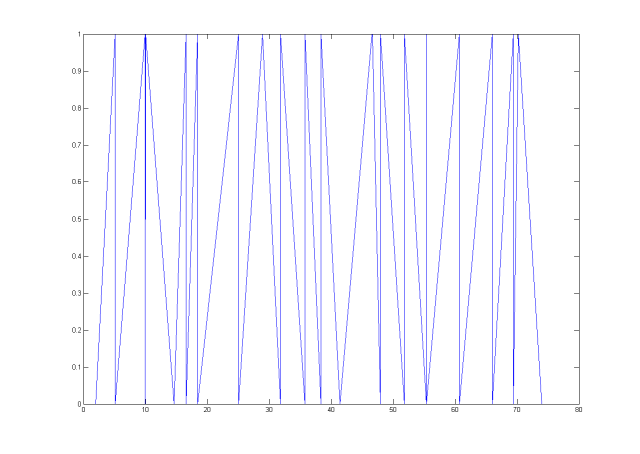

Изображен график функции .

Признак номер 1. Начальная длина шага равна 8.

Признак номер 1. Начальная длина шага равна 4.

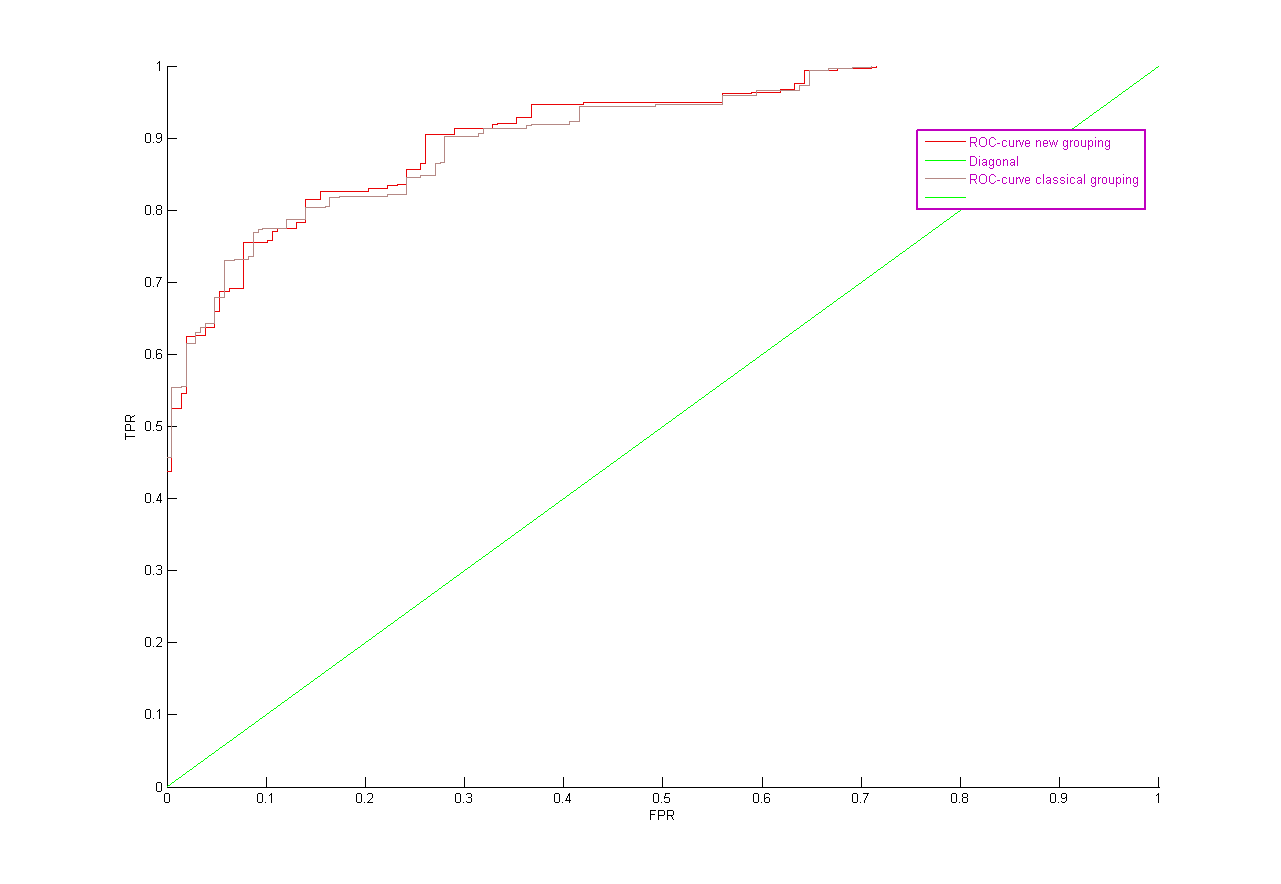

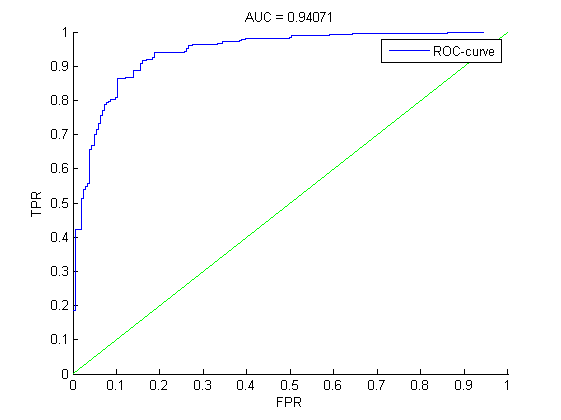

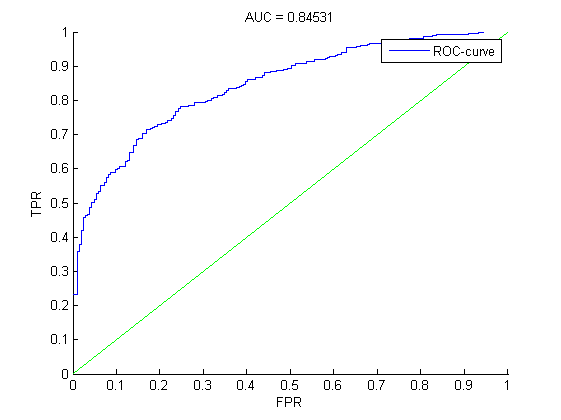

ROC - кривые

В случае группировки перебором.

Классическая группировка. С условием близости Weight of evidence равным 10. Дискретизация меньше , так как число групп больше чем в предыдущем случае.

С условием близости Weight of evidence равным 5.

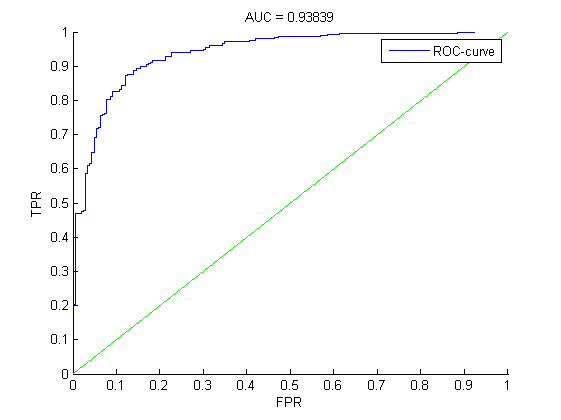

Сегментация линейных признаков. Шаг функции равен 2. Значения сильно изменяются, так как в группировке категорий линейные признаки были исключены.

Исследование свойств алгоритма

Значения Information Value для номинальных признаков

| 4 | 5 | 6 | 7 | 9 | 10 | 11 | 12 | 16 | 20 |

|---|---|---|---|---|---|---|---|---|---|

| 0.6670 | 0.2092 | 0.1960 | 0.0864 | 0.0036 | 0.1126 | 0.0576 | 0.0133 | 0.0322 | 0.0314 |

Значения S(w) на контрольной выборке

| Сегментация линейных | Классическая группировка | Альтернативная группировка |

|---|---|---|

| 123.2138 | 158.1518 | 145.6036 |

S(w) на контроле принимает наилучшее значение при сегментации линенйных признаков. Переборная группировка дает несколько лучшее по сравнению с классикой значение S(w) на контроле, зато сама модель несколько хуже, чем в классическом случае с точки зрения значения AUC.

Исходный код

- Исходный код Matlab

Смотри также

- Машинное обучение (курс лекций, К.В.Воронцов)

- Логистическая регрессия (пример)

- Логистическая функция

- Регрессионный анализ

- Алгоритм Ньютона-Рафсона

- Метод наименьших квадратов

Литература

- Siddiqi N. Credit Risk Scorecards: Developing and Implementing Intelligent Credit Scoring. John Wiley & Sons, Inc. 2006

- Bishop C. Pattern Recognition And Machine Learning. Springer. 2006.

- D. W. Hosmer, S. Lemeshow. Applied logistic regression. Wiley, New York, 2000.

| | Данная статья является непроверенным учебным заданием.

До указанного срока статья не должна редактироваться другими участниками проекта MachineLearning.ru. По его окончании любой участник вправе исправить данную статью по своему усмотрению и удалить данное предупреждение, выводимое с помощью шаблона {{Задание}}. См. также методические указания по использованию Ресурса MachineLearning.ru в учебном процессе. |