Математические основы теории прогнозирования (курс лекций)/2012/Задание СФ

Материал из MachineLearning.

| | Внимание! Текст задания находится в стадии формирования. Убедительная просьба не приступать к выполнению данного задания до тех пор, пока это предупреждение не будет удалено. |

|

Срок сдачи задания: 30 августа 2012, 23:59

Данное практическое задание предназначено, в первую очередь, для студентов Севастопольского филиала, которые имеют задолженность по курсу МОТП и не имеют возможности присутствовать в Москве на пересдачах осенью. Тем не менее, это задание могут выполнять и московские студенты ВМиК, которые имеют задолженность по курсу МОТП. Оценка за это задание будет итоговой оценкой по курсу МОТП.

Цель данного задания состоит в том, чтобы студенты познакомились на практике с популярными методами решения задач классификации и кластеризации — методом опорных векторов и методом к-средних, а также с базовыми аспектами, с которыми приходится сталкиваться при решении задач машинного обучения — проблемой переобучения и проблемой подбора структурных параметров алгоритма (таких как коэффициент С, параметры ядровых функций, количество кластеров в данных).

Необходимая теория

Метод опорных векторов

Рассматривается задача классификации на два класса. Имеется обучающая выборка , где

— вектор признаков для объекта

, а

— его метка класса. Задача заключается в предсказании метки класса

для объекта, представленного своим вектором признаков

.

В методе опорных векторов предсказание метки класса осуществляется по знаку линейной функции:

Для поиска весов и величины сдвига

решается следующая задача квадратичного программирования:

Здесь — параметр алгоритма, который задает компромисс между точностью распознавания обучающей выборки и величиной зазора между данными и гиперплоскостью (надежностью классификации).

После решения задачи квадратичного программирования оптимальный вектор весов вычисляется как

.

Очевидно, что только те объекты обучающей выборки, для которых , влияют на оптимальный вектор весов. Такие объекты получили название опорных. Пусть

. Тогда оптимальная величина сдвига гиперплоскости

определяется как

.

На практике здесь лучше проводить усреднение по всем . Если в оптимальном

все коэффициенты равны только нулю и

, то тогда коэффициент

может быть найден перебором путем минимизации ошибки распознавания обучающей выборки.

Использование ядровых функций

Для построения нелинейных решающих правил с помощью метода опорных векторов вводится понятие ядровой функции. Пусть имеется преобразование из исходного признакового пространства в новое пространство

, задаваемое функцией

. Пусть также имеется ядровая функция

, которая задает скалярное произведение в новом пространстве

:

Тогда для построения линейной разделяющей гиперплоскости в новом пространстве достаточно знать лишь ядровую функцию

и не требуется знать само преобразование

. В этом случае на этапе обучения метода решается следующая задача квадратичного программирования:

При этом скалярное произведение оптимального вектора весов и произвольного объекта

определяется как

По-прежнему, только опорные объекты (для которых ) вносят вклад в значение данного скалярного произведения. Величина сдвига гиперплоскости, как и раньше, определяется как

Если все коэффициенты принимают только крайние значения, то оптимальный сдвиг

находится путем минимизации числа ошибок на обучающей выборке.

Ядровая функция, как правило, выбирается в одном из следующих параметрических семейств:

- Линейная:

,

- Степенная:

.

- Радиальная:

.

В случае степенной ядровой функции делается неявное предположение о том, что данные отнормированы на нулевой центр и единичную дисперсию. В этом случае, по неравенству Коши-Буняковского, величина всегда будет неотрицательной.

Скользящий контроль

В методе опорных векторов параметр регуляризации , а также параметры ядровых функций (например, параметр

в радиальной ядровой функции) являются структурными параметрами, которые

не могут быть настроены путем минимизации числа ошибок на обучающей выборке. Для их настройки используются критерии выбора модели, например, скользящий контроль.

Обозначим обучающую выборку через , а через

— результат прогноза метки класса для объекта

, полученный с помощью алгоритма

, обученного по выборке

.

При

-кратном скользящем контроле обучающая выборка

разбивается на

равных частей

. Общая величина ошибки на

-кратном скользящем контроле вычисляется как

.

Здесь через обозначена обучающая выборка без части

, а через

— индикаторная функция, равная единице при выполнении условия

.

Наиболее популярная версия скользящего контроля — усреднение по пяти независимым запускам 2-кратного скользящего контроля. При таком подходе необходимо обучать алгоритм только по половине обучающей выборки (что происходит быстрее, чем обучение, например, по 9/10 от объема обучающей выборки). Во-вторых, здесь требуется всего 10 различных обучений (что гораздо меньше, чем, например, объем обучающей выборки

при разбиении выборки на

частей).

Настройка параметра регуляризации с помощью скользящего контроля производится следующим образом. Выбирается набор возможных значений

, например,

. Для каждого из этих значений вычисляется величина ошибки скользящего контроля (например, с помощью усреднения по пяти запускам 2-кратного скользящего контроля). В результате выбирается такое значение

, для которого величина ошибки скользящего контроля является наименьшей. В том случае, если требуется настроить два параметра, например

и

в радиальных базисных функциях, то выбирается двухмерная сетка значений параметров и находится та пара, для которой ошибка на скользящем контроле является наименьшей.

Схема решения задач классификации

В простейшем случае для решения задачи классификации имеющаяся в распоряжении выборка разбивается на три подвыборки: обучающую, валидационную и тестовую. Сначала выбирается некоторая модель алгоритмов, например, метод опорных векторов с радиальной ядровой функцией. По обучающей выборке в скользящем контроле настраиваются все структурные параметры выбранной модели (для метода опорных векторов с радиальной ядровой функцией в качестве таковых выступают коэффициент регуляризации и параметр

). Затем с выбранными значениями структурных параметров производится обучение модели алгоритмов по обучающей выборке. Полученный алгоритм тестируется на обучающей и валидационной выборке. В том случае, если значения обеих ошибок значимо отличаются друг от друга (следовательно, есть переобучение) или их значения близки между собой и достаточно большие (значит, есть недообучение), то выбранная модель алгоритмов признается неудачной и выбирается другая модель алгоритмов (более простая, если ранее было обнаружено переобучение, или более сложная, если ранее было обнаружено недообучение). После того, как удается найти хорошую модель алгоритмов (у которой нет переобучения и недообучения), обучающая и валидационная выборка объединяются между собой и используются в качестве обучающей для настройки структурных параметров по скользящему контролю и последующего обучения в найденной хорошей модели алгоритмов. Затем полученный алгоритм тестируется на объединенной обучающей и тестовой выборке. Если обе ошибки близки между собой и достаточно маленькие по значению, то такой алгоритм признается оптимальным для решения задачи классификации.

Метод K средних

Рассматривается задача кластеризации. Имеется выборка , где

— вектор признаков для объекта

. Задача состоит в разбиении этой выборки на

непересекающихся групп (кластеров)

так, чтобы объекты одной группы были похожи друг на друга, а объекты разных групп — отличались друг от друга.

Введем критерий качества кластеризации следующим образом:

, где

.

Метод K средних представляет собой жадный алгоритм минимизации критерия . Пусть имеется некоторое текущее разбиение выборки на кластеры

. Тогда одна итерация метода К средних выглядит следующим образом:

- Найти центры текущих кластеров

:

;

- Перераспределить объекты по кластерам путем отнесения к ближайшему центру:

, если

.

Итерационный процесс продолжается до стабилизации значения . Заметим, что в ходе итераций возможна ситуация, когда объекты перераспределяются не по всем

кластерам. В результате значение

может сократиться.

Очевидно, что представленный алгоритм позволяет найти лишь локальный минимум критерия . Поэтому на практике алгоритм минимизации запускается из нескольких случайных начальных кластеризаций, а в качестве итоговой кластеризации признается та, для которой значение

оказалось наименьшим.

Формулировка задания

Для выполнения задания на оценку «удовлетворительно» необходимо выполнить следующие пункты:

- Реализовать процедуру обучения/тестирования/подбора структурных параметров метода опорных векторов по описанному ниже прототипу;

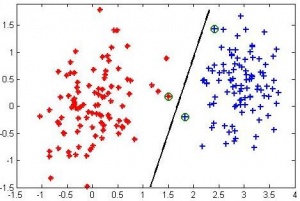

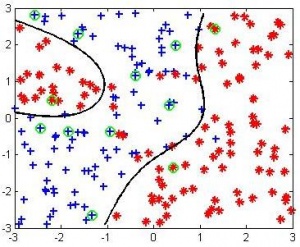

- Продемонстрировать на модельных данных для метода опорных векторов эффект переобучения (маленькая ошибка на обучении, большая ошибка на тесте), эффект недообучения (ошибки на обучении и тесте близки между собой и большие по величине) и ситуацию нормальной работы (ошибки на обучении и тесте близки между собой и маленькие по величине);

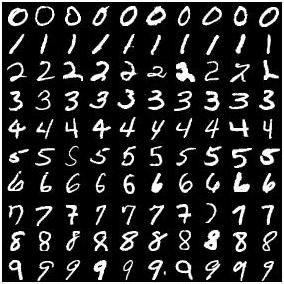

- Решить с помощью метода опорных векторов практическую задачу распознавания рукописных цифр (описание задачи см. ниже) для нескольких пар цифр, например, 4 и 9 или 5 и 6;

- Составить отчет в формате PDF обо всех проведенных исследованиях; данный отчет должен содержать необходимые графики и описание экспериментов, выводы необходимых формул, описание полученных результатов решения практических задач, общие выводы по исследованию.

Для выполнения задания на оценку «хорошо» необходимо дополнительно к вышеуказанным пунктам выполнить:

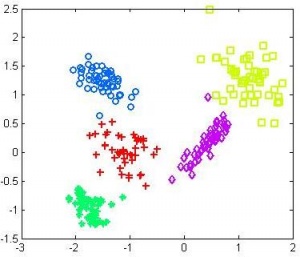

- Реализовать процедуру кластеризации по методу к-средних по описанному ниже прототипу;

- Продемонстрировать на модельных данных для метода к-средних результаты адекватной и неадекватной кластеризации при условии, что истинное количество кластеров известно (под неадекватной кластеризацией понимается принципиальная негодность метода к-средних для данной выборки, а не локальный минимум функционала

);

- Применить метод кластеризации к-средних для задачи распознавания рукописных цифр; сравнить результаты с аналогичными для метода опорных векторов;

- Результаты всех проведенных исследований добавить в отчет.

Для выполнения задания на оценку «отлично» необходимо дополнительно к вышеуказанным пунктам выполнить:

- Предложить и реализовать процедуру обучения/тестирования/подбора структурных параметров метода опорных векторов для случая многих классов; некоторые идеи обобщения метода опорных векторов на многоклассовый случай изложены здесь и здесь;

- Применить многоклассовый метод опорных векторов для практической задачи распознавания рукописных цифр;

- Результаты всех проведенных исследований добавить в отчет.

Спецификация реализуемых функций

Задание выполняется в среде MATLAB. Необходимые алгоритмы должны быть реализованы по прототипам, указанным ниже.

| Обучение метода опорных векторов | |||||||||

|---|---|---|---|---|---|---|---|---|---|

| a = svm_train(X, t, options) | |||||||||

| ВХОД | |||||||||

| |||||||||

| ВЫХОД | |||||||||

|

Обратите внимание: параметры N и D определяются неявно по размеру соответствующих элементов.

| Тестирование метода опорных векторов | |||

|---|---|---|---|

| [ErrorRate, Answers, Outputs] = svm_test(a, X, t) | |||

| ВХОД | |||

| |||

| ВЫХОД | |||

|

| Кластеризация по методу К средних | ||||||

|---|---|---|---|---|---|---|

| [idx, C] = k_means(X, K, options) | ||||||

| ВХОД | ||||||

| ||||||

| ВЫХОД | ||||||

|

Рекомендации по выполнению задания

1. Эффективное программирование под MATLAB предполагает активнейшее использование векторных и матричных операций. В частности, по возможности следует избегать любых циклов. Например, для вычисления матрицы попарных расстояний между набором объектов, задаваемых матрицами и

, можно воспользоваться свойством

, что в MATLAB может быть реализовано как

normX = sum(X.^2,2);

normY = sum(Y.^2,2);

diffXY = bsxfun(@plus, bsxfun(@plus, -2*(X*Y'), normX), normY');

Для быстрого ознакомления со средой MATLAB и особенностью программирования в ней рекомендуется глава 15 учебного пособия.

2. При работе с выборками для устойчивости всех производимых вычислений рекомендуется осуществлять нормировку выборки независимо для каждого признака таким образом, чтобы среднее значение по выборке равнялось нулю, а выборочная дисперсия — единице. При этом следует иметь в виду, что для тестовых выборок нужно использовать нормировочные коэффициенты, полученные для обучающих выборок.

3. Решение задачи квадратичного программирования в среде MATLAB производится с помощью функции quadprog. При этом в качестве алгоритма решения задачи рекомендуется выбрать interior-point-convex, а также уменьшить значение параметра точности по удовлетворению ограничениям 'TolCon' до 1e-15, чтобы точнее находить множество опорных объектов.

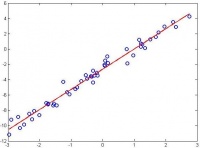

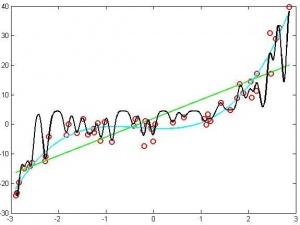

4. Проверять корректность реализации обучения и тестирования линейной/логистической регрессии следует, в первую очередь, на модельных данных. Например, для проверки линейной регрессии можно сгенерировать данные с одним признаком, в которых регрессионная переменная вычисляется как значение полинома некоторой степени от значения признака со сгенерированными коэффициентами плюс небольшой нормальный шум. Тогда при обучении линейной регрессии с полиномиальными базисными функциями и правильной степенью полинома результат предсказания должен быть очень хорошим. Эту ситуацию можно отобразить и визуально. Например, для случая полинома первой степени картинка может выглядеть так:

Кроме того, при автоматическом определении степени полинома по скользящему контролю выбираемое значение степени должно совпадать или быть близким к истинному.

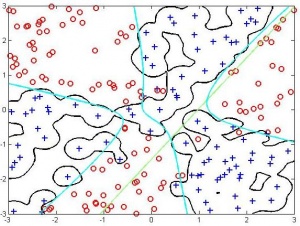

5. Эффекты переобучения/недообучения для метода опорных векторов можно продемонстрировать следующим образом: сгенерировать двухмерные данные с существенно нелинейной разделяющей поверхностью и обучить метод опорных векторов с радиальной ядровой функцией с различными значениями параметра . Тогда маленькие значения

должны приводить к недообучению, большие значения

— к переобучению, а некоторое среднее значение

будет соответствовать адекватной разделяющей поверхности.

Описание практической задачи

Рассматривается задача распознавания рукописных цифр MNIST. Исходные данные можно скачать здесь. В этой задаче объектами являются черно-белые изображения размера , на каждом из которых представлена одна рукописная цифра, а метками класса являются сами цифры. Таким образом, в данном случае рассматривается задача классификации на 10 классов.

Процедура сдачи задания

Оформление задания

Необходимо в срок до 1 сентября 2011 прислать выполненный вариант задания письмом по адресу bayesml@gmail.com с темой «Задание СФ, ФИО, номер группы». Убедительная просьба присылать выполненное задание только один раз с окончательным вариантом. Новые версии будут рассматриваться только в самом крайнем случае. Также убедительная просьба строго придерживаться заданной выше спецификации реализуемых функций. Очень трудно проверять большое количество заданий, если у каждого будет свой формат реализации.

Письмо должно содержать:

- PDF-файл с описанием проведенных исследований (отчет должен включать в себя описание выполнения каждого пункта задания с приведением соответствующих графиков, изображений, чисел)

- Файлы linreg_train.m, linreg_test.m, logreg_train.m, logreg_test.m или аналогичные им исполняемые файлы

- Набор вспомогательных файлов при необходимости

Защита задания

После сдачи выполненного задания и его проверки необходимо будет защитить свое задание. В том случае, если в какой-то части выполненного задания будет обнаружен плагиат с заданием другого студента, то задание не будет засчитано для обоих студентов! Защита задания будет осуществляться с помощью видео-чата для студентов СФ и во время осенних пересдач для московских студентов. Студенту будет предложен ряд вопросов по присланному коду и проведенным исследованиям. Кроме того, возможны задания по небольшой модификации кода в режиме онлайн.