Многомерная интерполяция и аппроксимация на основе теории случайных функций

Материал из MachineLearning.

(→Многомерная интерполяция.) |

(→Многомерная интерполяция.) |

||

| Строка 62: | Строка 62: | ||

Для поиска минимума (7) при системе ограничений (6), воспользуемся методом множителей Лагранжа. | Для поиска минимума (7) при системе ограничений (6), воспользуемся методом множителей Лагранжа. | ||

:Найдем Функцию Лагранжа: | :Найдем Функцию Лагранжа: | ||

| + | {{eqno|8}} | ||

| + | <p align="center"> | ||

| + | <tex>L(v_1,...,v_m,\lambda_1,...,\lambda_k)=v_1^2+v_2^2+...+v_m^2+\sum^{k}_{j=1} {\lambda_j ((\sum^{m}_{i=1} {v_i\varphi_i(x_j)})-y_j)}</tex> | ||

| + | </p><br\> | ||

| + | Обозначим вектором <tex>V^*(v_1^*,v_2^*,...,v_m^*)</tex> решение задачи. <br\> | ||

| + | Из условия <tex>\frac {dL}{d\lambda_j}=0</tex> опять получим уравнения (6).<br\> | ||

| + | Из условия <tex>\frac {dL}{dv_i}=0</tex> получим: <br\> | ||

| + | {{eqno|9}} | ||

| + | <p align="center"> | ||

| + | <tex>v_i^*=-0.5 \sum^{k}_{j=1} {\lambda_j \varphi_i (x_j),\;i=1,...,m}</tex> | ||

| + | </p><br\> | ||

| + | Обозначим последовательности значений координатных функций <tex>(\varphi_1(x_i),\varphi_2,(x_i),...,\varphi_m(x_i))</tex> как вектора <tex>L_i\;,\;i=1,...,k\;,\;L_i\in R^m</tex>. | ||

| + | <br\><br\> | ||

| + | Введем коэффициенты <tex>q_1,q_2,...,q_k\;,</tex> обозначив <tex>q_i=-0.5\lambda_i\;,\;i=1,..,k</tex>. | ||

| + | Тогда (9) можно записать через новые обозначения в виде линейной комбинации векторов (10):<br\> | ||

| + | {{eqno|10}} | ||

| + | <p align="center"> | ||

| + | <tex>V^*=q_1L_1+q_2L_2+...+q_kL_k</tex> | ||

| + | </p> | ||

| + | *Выражение (10) можно интерпретировать с геометрической точки зрения. Поиск минимума функции (7), с системой ограничений (6), равносилен опусканию перпендикуляра из начала координат на гиперплоскость, образуемую пересечением гиперплоскостей, заданных в виде уравнений (6) (подставив в (6) значения координатных функций, мы можем понимать их как задание гиперплоскостей и их пересечения в n-мерном пространстве), следовательно, <tex>V^*</tex> будет являться линейной комбинацией их перпендикуляров.<br\> | ||

| + | Систему ограничений (6) можно записать через скалярные произведения векторов (11): | ||

| + | {{eqno|11}} | ||

| + | <center><tex>\{\begin{array}{ccccc} L_1V^*=y_1\\ L_2V^*=y_2\\ \vdots\\ L_kV^*=y_k\\\end{array}</tex></center><br\> | ||

| + | Заменив <tex>V^*</tex> изпользуя (10) получаем систему уравнений:<br\> | ||

| + | {{eqno|12}} | ||

| + | <center><tex>\{\begin{array}{ccccc} q_1L_1L_1+q_2L_1L_2+...+q_kL_1L_k=y_1\\ q_1L_2L_1+q_2L_2L_2+...+q_kL_2L_k=y_2\\ \vdots\\ q_1L_kL_1+q_2L_kL_2+...+q_kL_kL_k=y_k\\\end{array}</tex></center><br\> | ||

| + | Обозначим как вектор <tex>L_*</tex> последовательность значений <tex>(\varphi_1(x),\varphi_2(x),...,\varphi_m(x))\;,\;x\in R^n</tex>.<br\> | ||

| + | Тогда наиболее вероятную реализацию <tex>y=f^*(x)</tex> случайной функции (3) можно выразить как выражение (13): <br\> | ||

| + | {{eqno|13}} | ||

| + | <p align="center"> | ||

| + | <tex>f^*(x)=\sum^{m}_{i=1} {v_i^*\varphi_i(x)}=L_*V^*=q_1L_*L_1+q_2L_*L_2+...+q_kL_*L_k</tex> | ||

| + | </p> | ||

| + | <br\> | ||

| + | Рассмотрим более подробно скалярное произведение <tex>L_iL_j</tex> : | ||

| + | {{eqno|14}} | ||

| + | <p align="center"> | ||

| + | <tex>L_iL_j=\sum^{m}_{t=1} {\varphi_t(x_i) \varphi_t(x_j)}=K_f(x_i,x_j)\;,\;x_i,x_j \in R^n</tex><br\> | ||

| + | что является не чем иным как каноническим разложением корреляционной функции. | ||

| + | </p><br\> | ||

| + | Тогда систему уравнений (12) можно записать в виде (15): | ||

| + | {{eqno|15}} | ||

| + | <center><tex>\{\begin{array}{ccccc} q_1K_f(x_1,x_1)+q_2K_f(x_1,x_2)+...+q_kK_f(x_1,x_k)=y_1\\ q_1K_f(x_2,x_1)+q_2K_f(x_2,x_2)+...+q_kK_f(x_2,x_k)=y_2\\ \vdots\\ q_1K_f(x_k,x_1)+q_2K_f(x_k,x_2)+...+q_kK_f(x_k,x_k)=y_k\\\end{array}</tex></center><br\> | ||

| + | а выражение (13), для наиболее вероятной реализации, в виде (16): | ||

| + | {{eqno|16}} | ||

| + | <p align="center"> | ||

| + | <tex>f^*(x)=q_1K_f(x,x_1)+q_2K_f(x,x_2)+...+q_kK_f(x,x_k)</tex> | ||

| + | </p> | ||

| + | <br\> | ||

| + | *Таким образом, можно сделать вывод, что наиболее вероятной реализацией случайной функции (3), удовлетворяющей узлам интерполяции, будет линейная комбинация сечений ее корреляционных функций. | ||

| + | *Следовательно, зная корреляционную функцию и решив систему уравнений (15), мы получим наиболее вероятную реализацию (16) в рамках данной случайной функции. | ||

| + | *Если же теперь рассмотреть интерполяцию как вариант метода машинного обучения то полученный результат можно легко обобщить на вариант с несколькими выходами, поскольку левая часть уравнений (15) для разных выходных переменных будет одинаковой (если конечно зависимость между входами и разными выходами можно рассматривать, пользуясь одной случайной функцией). В этом случае можно вычислить единую обратную матрицу уравнений (15), которую можно использовать для интерполяции при любых возможных вариантах значений выходных переменных. | ||

| + | *Однако чтобы осуществить подобные расчеты, необходимо знать, какой корреляционной функцией пользоваться (или знать все координатные функции, что будет достаточно для вычисления корреляционной функции), а также знать функцию математического ожидания в (2) либо корректно преобразовать в (3). | ||

| + | <br\>Рассмотрим случай, когда нет априорной информации о том, в рамках какой случайной функции можно решать задачу интерполяции. Устранение неопределенности осуществляется выбором корреляционной функции, сделав определенные предположения. | ||

| + | *Предположим, что изначально потенциальными вариантами интерполянта (искомой функции) могут быть любые непрерывные вещественные функции и об их априорном распределении вероятностей между собой не известно. Предположим, что в этом случае, априорно любые точки, а также направления в пространстве интерполяции равнозначны между собой. Поэтому потребуем, чтобы интерполяция не зависела от выбора системы отсчета узлов интерполяции, от операций ее поворота, положения начала координат и масштаба. Т.е. если мы в пространстве интерполяции введем новую систему отсчета (оси координат, путем операций поворота и сдвига исходных), найдем координаты узлов интерполяции в этой новой системе отсчета и выполним интерполяцию, то полученная функция, при переводе ее в исходную систему отсчета должна совпасть с функцией, полученной по исходным узлам. Потребуем выполнения того же свойства и при переходе к новой системе отсчета путем одновременного изменения масштаба по всем координатам (умножив на единый коэффициент значения всех входных и выходных переменных). | ||

| + | *Эти требования можно обеспечить, введя набор положений об априорных вероятностях существования той или иной реализации рассматриваемой случайной функции. Примем априорно равновероятными реализации преобразующиеся друг в друга с помощью операций сдвига поворота или являющиеся подобными друг другу при изменении масштаба. Это допущение обеспечивает выполнение свойств интерполяции при переходе к другой системе отсчета (описанные выше). Действительно, если это допущение выполняется, то при переходе к другой системе отсчета (любым описанным выше способом) появляется возможность отобразить множество реализаций на самого себя таким образом, что мы получим эквивалентную задачу. | ||

| + | *Обозначенных выше требований, не смотря на то, что они и так выглядят естественными в условиях априорной неопределенности, достаточно, чтобы однозначно вычислить корреляционную функцию, необходимую для выражений (15) и (16). | ||

| + | <br\>Обозначим сформулированные требования в виде набора положений:<br\> | ||

| + | 1. Плотность вероятности реализаций, преобразующихся друг в друга параллельным переносом системы координат должна быть одинаковой. Предположим, что мы имеем две реализации <tex>f_1(x)</tex> и <tex>f_2(x)</tex> такие, что: | ||

| + | {{eqno|17}} | ||

| + | <p align="center"> | ||

| + | <tex>\forall x \;f_1(x)=f_2(x+t),\;x,t \in R^n\;,\;t=const</tex> | ||

| + | </p> | ||

| + | Тогда плотность вероятности реализаций <tex>f_1(x)</tex> и <tex>f_2(x)</tex> должна быть равна. | ||

| + | <br\>2. Плотность вероятности реализаций, преобразующихся друг в друга одинаковым изменением масштаба по всем направлениям должна быть одинаковой. Предположим, что мы имеем две реализации <tex>f_1(x)</tex> и <tex>f_2(x)</tex> такие, что: | ||

| + | {{eqno|18}} | ||

| + | <p align="center"> | ||

| + | <tex>\forall x \;f_1(x)=kf_2(x/k),\;x \in R^n</tex><br\> | ||

| + | где <tex>k</tex> - некоторый коэффициент | ||

| + | </p> | ||

| + | Тогда плотность вероятности реализаций <tex>f_1(x)</tex> и <tex>f_2(x)</tex> должна быть равна. | ||

| + | <br\> | ||

| + | 3. Плотность вероятности реализаций, преобразующихся друг в друга поворотом системы координат должна быть одинаковой. Предположим, что мы имеем две реализации <tex>f_1(x)</tex> и <tex>f_2(x)</tex> такие, что: | ||

| + | {{eqno|19}} | ||

| + | <p align="center"> | ||

| + | <tex>\forall x_1 \;f_1(x_1)=f_2(x_2),\; x_2=Ax_1,\;x_1,x_2 \in R^n</tex><br\> | ||

| + | где <tex>A</tex> - некоторая матрица поворота | ||

| + | </p> | ||

| + | Тогда плотность вероятности реализаций <tex>f_1(x)</tex> и <tex>f_2(x)</tex> должна быть равна. | ||

| + | <br\> | ||

| + | *Выполнение первого пункта означает, что случайная функция будет стационарной. В этом случае ее можно записать в виде многомерного спектрального разложения. Обозначим <tex>S(\omega)</tex> ее спектральную плотность (неотрицательная вещественная функция, симметричная относительно любых частот <tex>\omega</tex> и <tex>-\omega</tex>). | ||

| + | {{eqno|20}} | ||

| + | <p align="center"> | ||

| + | <tex>f(x)=\frac {1}{{(2\pi)}^{\frac {n}{2}}} \int\limits_{R^n}S^*(\omega)\sqrt{S(\omega)}e^{ix\omega}d\omega</tex><br\> | ||

| + | <tex>x,\omega \in R^n\;,\;x\omega</tex> - их скалярное произведение | ||

| + | </p> | ||

| + | *В выражении (20) <tex>S^*(\omega)</tex> - реализация комплексной случайной функции, каждое значение которой является независимой случайной величиной (кроме дополнительного условия, о котором ниже) имеющей нормальное распределение, единичную дисперсию и математическое ожидание равное нулю, как для вещественной, так и мнимой части. Выражение (20) можно считать частным случаем (3), в котором <tex>m=\infty</tex> , роль координатных функций выполняет <tex>\sqrt{S(\omega)}e^{ix\omega}</tex>, а аналогом значений случайных величин выступает <tex>S^*(\omega)</tex>. Функцию можно считать разложением реализации по базису функций пропорциональному <tex>\sqrt{S(\omega)}e^{ix\omega}</tex>. | ||

| + | *Наложим дополнительное условие на <tex>S^*(\omega)</tex>(а соответственно, на случайную функцию), поскольку мы рассматриваем в данный момент интерполяцию вещественных функций, то ее значения для любых значений частот <tex>\omega</tex> и <tex>-\omega</tex>) должны быть комплексно-сопряженными. Чтобы отразить это условие поделим пространство частот <tex>R^n</tex> на две части <tex>R_1^n</tex> и <tex>R_2^n</tex>. Осуществить это разделение нужно таким образом, чтобы любые частоты <tex>\omega</tex> и <tex>-\omega</tex>) лежали разных частях (например, любой гиперплоскостью, проходящей через начало координат). Тогда <tex>S^*(\omega)</tex> можно записать как: | ||

| + | {{eqno|21}} | ||

| + | <center><tex>S^*(\omega)=\{\begin{array}{ccccc} R^*(\omega)+iI^*(\omega),\;\omega\in R_1^n\\ R^*(\omega)-iI^*(\omega),\;\omega\in R_2^n\\\end{array}</tex></center><br\> | ||

| + | *Где <tex>R^*(\omega)</tex> и <tex>I^*(\omega)</tex> можно рассматривать как реализации вещественных случайных функций, каждое значение которых одинаково для частот <tex>\omega</tex> и <tex>-\omega</tex>), является независимой случайной величиной, имеющей нормальное распределение, математическое ожидание равное нулю и дисперсию равную единице.<br\> | ||

| + | При выполнении условия на вещественность реализаций случайную функцию (20) можно записать как (22): | ||

| + | {{eqno|22}} | ||

| + | <p align="center"> | ||

| + | <tex>f(x)=\frac {1}{{(2\pi)}^{\frac {n}{2}}} (\int\limits_{R_1^n}(R^*(\omega)+iI^*(\omega))\sqrt{S(\omega)}e^{ix\omega}d\omega+\int\limits_{R_2^n}(R^*(\omega)-iI^*(\omega))\sqrt{S(\omega)}e^{ix\omega}d\omega)</tex> | ||

| + | </p> | ||

| + | Поскольку <tex>R_1^n</tex> и <tex>R_2^n</tex> симметричны относительно <tex>\omega</tex> и <tex>-\omega</tex>) , то во втором интеграле в (22) можно перейти к области интегрирования <tex>R_1^n</tex> заменив знак перед частотой. В этом случае получим: | ||

| + | {{eqno|23}} | ||

| + | <p align="center"> | ||

| + | <tex>f(x)=\frac {1}{{(2\pi)}^{\frac {n}{2}}} (\int\limits_{R_1^n}(R^*(\omega)+iI^*(\omega))\sqrt{S(\omega)}e^{ix\omega}d\omega+\int\limits_{R_1^n}(R^*(-\omega)-iI^*(-\omega))\sqrt{S(-\omega)}e^{-ix\omega}d\omega)</tex> | ||

| + | </p> | ||

| + | Выполнив далее преобразования, получим: | ||

| + | {{eqno|24}} | ||

| + | <p align="center"> | ||

| + | <tex>f(x)=\frac {1}{{(2\pi)}^{\frac {n}{2}}} \int\limits_{R_1^n}\sqrt{S(\omega)}(R^*(\omega)(e^{i\omega x}+e^{-i\omega x})+iI^*(\omega)(e^{i\omega x}-e^{-i\omega x}))d\omega=</tex><br\><tex>=\frac {2}{{(2\pi)}^{\frac {n}{2}}} \int\limits_{R_1^n}\sqrt{S(\omega)}(R^*(\omega)\cos(\omega x)-I^*(\omega)\sin(\omega x))d\omega</tex> | ||

| + | </p> | ||

| + | *Поскольку каждое значение <tex>S^*(\omega)</tex>(для пар частот <tex>\omega</tex> и <tex>-\omega</tex>)) является независимой комплексной случайной величиной, с математическим ожиданием равным нулю и дисперсией равной единице, мы можем получить (25) - аналог выражения (7), минимизация которого при выполнении ограничений на узлы интерполяции обеспечит наиболее вероятную реализацию. | ||

| + | {{eqno|25}} | ||

| + | <p align="center"> | ||

| + | <tex>\int\limits_{R_1^n}\mid S^*(\omega)\mid^2 d\omega\rightarrow\min</tex> | ||

| + | </p><br\> | ||

| + | Для двух любых реализаций, имеющих одинаковую априорную вероятность значение (25) должно иметь одинаковое значение. | ||

| + | <br\>Выражение (25) можно записать как (26): | ||

| + | {{eqno|26}} | ||

| + | <p align="center"> | ||

| + | <tex>\int\limits_{R_1^n} (R^*(\omega)^2+I^*(\omega)^2) d\omega\rightarrow\min</tex> | ||

| + | </p><br\> | ||

| + | Пусть последовательность <tex>x_1,x_2,...,x_k\;(x_i\in R^n)</tex> и соответствующие им <tex>y_1,y_2,...,y_k\;(y_i\in R)</tex> - представляют собой узлы интерполяции. Тогда используя полученное выражение (24) ограничения на эти узлы будут представлять собой систему уравнений: | ||

| + | {{eqno|27}} | ||

| + | <center><tex>\{\begin{array}{ccccc} \frac {2}{{(2\pi)}^{\frac {n}{2}}} \int\limits_{R_1^n}\sqrt{S(\omega)}(R^*(\omega)\cos(\omega x_1)-I^*(\omega)\sin(\omega x_1))d\omega=y_1\\ \frac {2}{{(2\pi)}^{\frac {n}{2}}} \int\limits_{R_1^n}\sqrt{S(\omega)}(R^*(\omega)\cos(\omega x_2)-I^*(\omega)\sin(\omega x_2))d\omega=y_2\\ \vdots\\ \frac {2}{{(2\pi)}^{\frac {n}{2}}} \int\limits_{R_1^n}\sqrt{S(\omega)}(R^*(\omega)\cos(\omega x_k)-I^*(\omega)\sin(\omega x_k))d\omega=y_k\\\end{array}</tex></center><br\> | ||

| + | Поиск наиболее вероятной реализации будет соответствовать нахождению функций <tex>R^*(\omega)</tex> и <tex>I^*(\omega)</tex> таких, при которых выполняются условия (27) и минимизируется значение выражения (26). | ||

| + | :Дальнейшие рассуждения можно выполнить аналогично (8) – (16). | ||

| + | :Функция Лагранжа примет вид:<br\> | ||

| + | {{eqno|28}} | ||

| + | <p align="center"> | ||

| + | <tex>\int\limits_{R_1^n}(R^*(\omega)^2+I^*(\omega)^2)+\frac {2}{{(2\pi)}^{\frac {n}{2}}} \sum^{k}_{i=1}\lambda_i (\int\limits_{R_1^n}\sqrt{S(\omega)}(R^*(\omega)\cos(\omega x_i)-I^*(\omega)\sin(\omega x_i))d\omega-y_i)</tex> | ||

| + | </p> | ||

| + | При дифференцировании (28) по <tex>\lambda_i</tex> можно снова получить систему (27).<br\> | ||

| + | Поскольку любое значение функций <tex>R^*(\omega)</tex> и <tex>I^*(\omega)</tex> для произвольного <tex>\omega</tex> выражения (28) можно считать независимой переменной, то соответственно по каждому из них можно выполнить независимое дифференцирование. В этом случае получим выражения: | ||

| + | {{eqno|29}} | ||

| + | <p align="center"> | ||

| + | <tex>R^*(\omega)=-\frac{\sqrt{S(\omega)}}{{(2\pi)}^{\frac {n}{2}}}\sum^{k}_{i=1}\lambda_i\cos(\omega x_i)</tex> | ||

| + | </p> | ||

| + | {{eqno|30}} | ||

| + | <p align="center"> | ||

| + | <tex>I^*(\omega)=\frac{\sqrt{S(\omega)}}{{(2\pi)}^{\frac {n}{2}}}\sum^{k}_{i=1}\lambda_i\sin(\omega x_i)</tex> | ||

| + | </p> | ||

| + | Подставив решения (29) и (30) в систему (24) получим выражение наиболее вероятной реализации: | ||

| + | {{eqno|31}} | ||

| + | <p align="center"> | ||

| + | <tex>f(x)=-\frac {2}{{(2\pi)}^{\frac {n}{2}}}\sum^{k}_{i=1}\lambda_i \int\limits_{R_1^n}S(\omega)(\cos(\omega x_i)\cos(\omega x)+\sin(\omega x_i)\sin(\omega x))d\omega</tex> | ||

| + | </p> | ||

| + | Выражение (31) преобразуется в (32): | ||

| + | {{eqno|32}} | ||

| + | <p align="center"> | ||

| + | <tex>f(x)=-\frac {2}{{(2\pi)}^{\frac {n}{2}}}\sum^{k}_{i=1}\lambda_i \int\limits_{R_1^n}S(\omega)\cos(\omega(x_i-x))d\omega</tex> | ||

| + | </p> | ||

| + | Поскольку подынтегральное выражение в (32) инвариантно к изменению <tex>\omega</tex> на <tex>-\omega</tex>, то мы можем перейти целиком в область интегрирования <tex>R^n</tex>: | ||

=== Дисперсия случайной функции. Множество реализаций, удовлетворяющих узлам интерполяции. === | === Дисперсия случайной функции. Множество реализаций, удовлетворяющих узлам интерполяции. === | ||

Версия 10:04, 30 июля 2009

Содержание |

Вступление

(в настоящий момент идет ввод и редактирование статьи, в силу того, что объем довольно значителен а опыта разметки еще нет (прошу прощения за это), сначала планирую выложить описание самого итогового метода, чтобы читатели смогли при желании с ним ознакомиться, затем примеры реализации функций и демонстрации в Matlab, а затем теоретическую часть с обоснованием)

- Данную статью условно можно поделить на две части.

- Первая часть посвящена использованию основ теории случайных функций применительно к задачам многомерной интерполяции и аппроксимации, а также машинному обучению и их теоретическому обоснованию. Цель теоретической части показать, что машинное обучение в его парадигме “обучения с учителем”, задачи многомерной интерполяции и аппроксимации, могут быть обобщены на основе теории случайных функций.

- Во второй части изложены практические выводы из положений первой части в виде законченного метода машинного обучения (метода многомерной интерполяции и аппроксимации). Если читателя интересуют сугубо практические вопросы, Вы можете перейти сразу к изложению метода.

- Предложенный метод позволяет получить точное решение задачи многомерной интерполяции или аппроксимации (“обучение с учителем”) гарантирующее оптимальность (при определенных минимальных допущениях, указанных в теоретической части). Метод достаточно прост и сводится к системе линейных уравнений, что может у читателя не знакомого с вопросом без изучения теоретической части вызвать подозрения в работоспособности или обобщающей способности метода. Но смею Вас уверить, что столь простая математическая конструкция в данном случае никак не ограничивает возможности. Если постараться объяснить кратко, то способности метода обеспечивает “специальная функция”, полученная в теоретической части, применение которой в системе линейных уравнений гарантированно обеспечивает оптимальное, с точки зрения аппарата случайных функций, решение. Использование данной функции позволяет сводить задачи многомерной интерполяции и аппроксимации или самые разнообразные задачи машинного обучения (с определенными допущениями) к решению системы линейных уравнений, гарантируя оптимальность полученного решения, отсутствие переобучения, осцилляций интерполянта и других нежелательных эффектов (если говорить более строго, то в реальных вычислениях используется лишь приближение теоретической “идеальной” функции в используемой части спектра, функция, которую можно записать алгебраически).

Подход к многомерной интерполяции и аппроксимации на основе теории случайных функций.

Введение.

- Цель данной статьи показать, что машинное обучение в его парадигме “обучения с учителем”, задачи многомерной интерполяции и аппроксимации, могут быть обобщены на основе теории случайных функций.

Использование математического аппарата случайных функций удобно для теоретического обоснования методов машинного обучения, а понятие “вероятность реализации” может служить критерием для обоснования обобщающих способностей метода обучения.

- Ниже будет показано, что использование понятия случайной функции и связанных с ней теоретических построений позволяет получать точные решения задач машинного обучения как задач многомерной интерполяции (или аппроксимации) гарантируя оптимальность решения с точки зрения критерия вероятности. Существует способ при минимальных допущениях получить оптимальное решение задачи машинного обучения путем решения системы линейных уравнений (с доказательством его единственности и оптимальности). Это позволяет получить точное решение, что снимает проблему поиска глобального оптимума и выбора топологии сети, которые имеют место во многих существующих итеративных алгоритмах “обучения с учителем” искусственных нейронных сетей.

Теорией случайных процессов называется математическая наука, изучающая закономерности случайных явлений в динамике их развития. Аналогично тому, как понятие случайного процесса является обобщением понятия случайной величины, случайная функция является обобщением понятия случайного процесса, поскольку функции могут зависеть не от одного, а от нескольких аргументов.

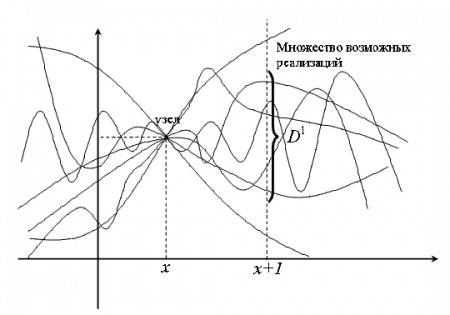

- Реализациями случайной функции являются функции, вид которых она принимает при наблюдении или, например, при проведении опыта. Сама же случайная функция представляет собой множество своих реализаций, с соответствующим распределением вероятностей. Для любой функции, проявления которой мы можем наблюдать, любую функцию которую мы можем в каком-либо смысле рассматривать, всегда можно поставить в соответствие случайную функцию, реализацией которой мы можем ее считать без каких-либо дополнительных предположений или допущений. Даже если мы рассматриваем какую-то конкретную функцию, например, вида y=2x, то и в этом случае мы можем ее считать частным случаем случайной функции, множество реализаций которой состоит из одного элемента с вероятностью реализации равной единице.

При решении задачи многомерной интерполяции или аппроксимации или при машинном обучении по набору примеров требуется связать с помощью некоторой функции значения входных и выходных переменных. Решая подобные задачи, требуется найти нужные функции, удовлетворяющие обучающим векторам, если это машинное обучение, либо узлам интерполяции в случае многомерной интерполяции, притом что таких функций, удовлетворяющих данным, может быть бесконечное множество.

- При создании любого метода решения, выбор всегда будет осуществляться на основе определенных положений. Рассмотрим задачу машинного обучения либо многомерную интерполяцию или аппроксимацию. Предположим, что искомую нами функцию можно рассматривать как реализацию некоторой случайной функции, о которой (о реализации) несет информацию рассматриваемый набор обучающих векторов (либо узлов интерполяции).

При таком подходе естественным критерием для поиска требуемой функции будет вероятность ее как реализации. Поиск нужной функции в этом случае превращается в поиск наиболее вероятной из реализаций случайной функции, которые удовлетворяют обучающим примерам либо узлам интерполяции в случае интерполяции.

- Эта идея является основой предлагаемого на рассмотрение в данной работе метода. Для любой наблюдаемой в окружающем мире функции всегда можно поставить в соответствие случайную функцию, реализацией которой она будет являться, поэтому считая искомую функцию реализацией случайной функции, не уточняя ее характеристик, мы пока еще не делаем никаких дополнительных предположении или допущений, но в то же время можем использовать математический аппарат теории случайных функций.

Адекватность такого подхода, его область применимости, будет целиком определяться тем, какими конкретными характеристиками мы наделим априорную случайную функцию, используя которую мы будем решать ту или иную задачу.

Многомерная интерполяция.

Рассмотрим задачу многомерной интерполяции, предполагая, что узлы интерполяции принадлежат реализации некоторой случайной функции.

- Предположим, что функцию (1) можно считать реализацией некоторой случайной функции

которую можно записать как (2):

где - координатные функции,

- случайные величины,

- функция математического ожидания

- Под координатными функциями в (2) мы можем понимать любые произвольные функции. Условие заключается в том, что существуют какие-то координатные функции, такие, что мы можем через них записать случайную функцию вида (2). Количество слагаемых в (2) может быть произвольным, т.е. полагаем, что m может быть любым, в том числе и равным бесконечности (как вариант, сумма в (2) может быть обобщена до интеграла). В качестве частного случая (2) можно рассматривать, например, разложение в бесконечный ряд синусов и косинусов, когда реализациями данной случайной функции может быть множество всех непрерывных вещественных функций.

- Предполагаем, что в (2) случайные величины

независимы, распределены по нормальному закону, с математическими ожиданиями равными нулю и дисперсией равной единице.

- Потенциально требование именно к нормальному закону на данном необязательно (но может быть спользовано в дальнейшем, например, при анализе и отображении подмножеств реализаций). Для выполнения следующих нескольких преобразований достаточно было бы потребовать, чтобы совместный закон распределения вероятностей для случайных величин из (2) был симметричным относительно начала координат и монотонно убывал с увеличением расстояний от начала координат.

- Требования в (2) для случайных величин к математическому ожиданию равному нулю и дисперсии равной единице сделаны для удобства дальнейших преобразований. Если они не выполняются, можно сделать преобразование, получив снова выражение (2), но чтобы эти требования были выполнены. Предположим, что для какой-либо случайной величины дисперсия не равна единице, тогда мы можем заменить ее и одновременно заменить соответствующую ей координатную функцию (умножив ее на коэффициент), снова получив выражение вида (2). Если же математическое ожидание какой-либо случайной величины в (2) не равно нулю, тогда можно выполнить преобразование, изменив функцию математического ожидания таким образом, чтобы опять свести к виду (2).

- Рассмотрим подробнее функцию

. В частном случае она может быть равна нулю или константе.

- Если эта функция заранее известна, то мы можем исключить ее из дальнейших преобразований, осуществив вычитание ее значений из узлов интерполяции и одновременно удалив из выражения (2). После того как интерполяция по модифицированным узлам будет выполнена мы можем снова прибавить ее к полученному решению для получения окончательного результата.

- Если эта функция заранее не известна, тогда мы можем принять ее за некую реализацию еще одной случайной функции которую можно снова выразить через выражение (2), и дальше повторять эту процедуру в случае необходимости.

Исключив функцию математического ожидания, получим выражение случайной функции:

- Обозначим через

конкретные значения случайных величин из (3), которые они приняли для какой-либо реализации. Тогда плотность распределения вероятностей реализаций в пространстве параметров

(т.е. вероятность реализации случайной функции вида (3), когда случайные величины

принимают некие конкретные значения

) запишется в виде (4):

Пусть последовательности

представляют собой координаты и соответствующие им значения узлов интерполяции.

- Считая, что узлы интерполяции принадлежат одной из реализаций случайной функции (3), которой соответствует вектор

, их можно выразить в виде системы уравнений (6):

- Используя приведенные выше выражения, можно сказать, что наиболее вероятной реализацией случайной функции вида (3) соответствующей узлам интерполяции будет та, при которой функция плотности вероятности (4) принимает максимальное значение с учетом системы ограничений в виде равенств (6).

Поиск максимума функции (4), равносилен поиску минимума функции (7):

- Отсюда можно сделать вывод, что решение задачи многомерной интерполяции как поиск наиболее вероятной реализации функции (2) или (3) удовлетворяющей узлам интерполяции, сводится к задаче квадратичного программирования с ограничениями в виде равенств.

Для поиска минимума (7) при системе ограничений (6), воспользуемся методом множителей Лагранжа.

- Найдем Функцию Лагранжа:

Обозначим вектором решение задачи.

Из условия опять получим уравнения (6).

Из условия получим:

Обозначим последовательности значений координатных функций как вектора

.

Введем коэффициенты обозначив

.

Тогда (9) можно записать через новые обозначения в виде линейной комбинации векторов (10):

- Выражение (10) можно интерпретировать с геометрической точки зрения. Поиск минимума функции (7), с системой ограничений (6), равносилен опусканию перпендикуляра из начала координат на гиперплоскость, образуемую пересечением гиперплоскостей, заданных в виде уравнений (6) (подставив в (6) значения координатных функций, мы можем понимать их как задание гиперплоскостей и их пересечения в n-мерном пространстве), следовательно,

будет являться линейной комбинацией их перпендикуляров.

Систему ограничений (6) можно записать через скалярные произведения векторов (11):

Заменив изпользуя (10) получаем систему уравнений:

Обозначим как вектор последовательность значений

.

Тогда наиболее вероятную реализацию случайной функции (3) можно выразить как выражение (13):

Рассмотрим более подробно скалярное произведение :

что является не чем иным как каноническим разложением корреляционной функции.

Тогда систему уравнений (12) можно записать в виде (15):

а выражение (13), для наиболее вероятной реализации, в виде (16):

- Таким образом, можно сделать вывод, что наиболее вероятной реализацией случайной функции (3), удовлетворяющей узлам интерполяции, будет линейная комбинация сечений ее корреляционных функций.

- Следовательно, зная корреляционную функцию и решив систему уравнений (15), мы получим наиболее вероятную реализацию (16) в рамках данной случайной функции.

- Если же теперь рассмотреть интерполяцию как вариант метода машинного обучения то полученный результат можно легко обобщить на вариант с несколькими выходами, поскольку левая часть уравнений (15) для разных выходных переменных будет одинаковой (если конечно зависимость между входами и разными выходами можно рассматривать, пользуясь одной случайной функцией). В этом случае можно вычислить единую обратную матрицу уравнений (15), которую можно использовать для интерполяции при любых возможных вариантах значений выходных переменных.

- Однако чтобы осуществить подобные расчеты, необходимо знать, какой корреляционной функцией пользоваться (или знать все координатные функции, что будет достаточно для вычисления корреляционной функции), а также знать функцию математического ожидания в (2) либо корректно преобразовать в (3).

Рассмотрим случай, когда нет априорной информации о том, в рамках какой случайной функции можно решать задачу интерполяции. Устранение неопределенности осуществляется выбором корреляционной функции, сделав определенные предположения.

- Предположим, что изначально потенциальными вариантами интерполянта (искомой функции) могут быть любые непрерывные вещественные функции и об их априорном распределении вероятностей между собой не известно. Предположим, что в этом случае, априорно любые точки, а также направления в пространстве интерполяции равнозначны между собой. Поэтому потребуем, чтобы интерполяция не зависела от выбора системы отсчета узлов интерполяции, от операций ее поворота, положения начала координат и масштаба. Т.е. если мы в пространстве интерполяции введем новую систему отсчета (оси координат, путем операций поворота и сдвига исходных), найдем координаты узлов интерполяции в этой новой системе отсчета и выполним интерполяцию, то полученная функция, при переводе ее в исходную систему отсчета должна совпасть с функцией, полученной по исходным узлам. Потребуем выполнения того же свойства и при переходе к новой системе отсчета путем одновременного изменения масштаба по всем координатам (умножив на единый коэффициент значения всех входных и выходных переменных).

- Эти требования можно обеспечить, введя набор положений об априорных вероятностях существования той или иной реализации рассматриваемой случайной функции. Примем априорно равновероятными реализации преобразующиеся друг в друга с помощью операций сдвига поворота или являющиеся подобными друг другу при изменении масштаба. Это допущение обеспечивает выполнение свойств интерполяции при переходе к другой системе отсчета (описанные выше). Действительно, если это допущение выполняется, то при переходе к другой системе отсчета (любым описанным выше способом) появляется возможность отобразить множество реализаций на самого себя таким образом, что мы получим эквивалентную задачу.

- Обозначенных выше требований, не смотря на то, что они и так выглядят естественными в условиях априорной неопределенности, достаточно, чтобы однозначно вычислить корреляционную функцию, необходимую для выражений (15) и (16).

Обозначим сформулированные требования в виде набора положений:

1. Плотность вероятности реализаций, преобразующихся друг в друга параллельным переносом системы координат должна быть одинаковой. Предположим, что мы имеем две реализации и

такие, что:

Тогда плотность вероятности реализаций и

должна быть равна.

2. Плотность вероятности реализаций, преобразующихся друг в друга одинаковым изменением масштаба по всем направлениям должна быть одинаковой. Предположим, что мы имеем две реализации и

такие, что:

где - некоторый коэффициент

Тогда плотность вероятности реализаций и

должна быть равна.

3. Плотность вероятности реализаций, преобразующихся друг в друга поворотом системы координат должна быть одинаковой. Предположим, что мы имеем две реализации и

такие, что:

где - некоторая матрица поворота

Тогда плотность вероятности реализаций и

должна быть равна.

- Выполнение первого пункта означает, что случайная функция будет стационарной. В этом случае ее можно записать в виде многомерного спектрального разложения. Обозначим

ее спектральную плотность (неотрицательная вещественная функция, симметричная относительно любых частот

и

).

- их скалярное произведение

- В выражении (20)

- реализация комплексной случайной функции, каждое значение которой является независимой случайной величиной (кроме дополнительного условия, о котором ниже) имеющей нормальное распределение, единичную дисперсию и математическое ожидание равное нулю, как для вещественной, так и мнимой части. Выражение (20) можно считать частным случаем (3), в котором

, роль координатных функций выполняет

, а аналогом значений случайных величин выступает

. Функцию можно считать разложением реализации по базису функций пропорциональному

.

- Наложим дополнительное условие на

(а соответственно, на случайную функцию), поскольку мы рассматриваем в данный момент интерполяцию вещественных функций, то ее значения для любых значений частот

и

) должны быть комплексно-сопряженными. Чтобы отразить это условие поделим пространство частот

на две части

и

. Осуществить это разделение нужно таким образом, чтобы любые частоты

и

) лежали разных частях (например, любой гиперплоскостью, проходящей через начало координат). Тогда

можно записать как:

- Где

и

можно рассматривать как реализации вещественных случайных функций, каждое значение которых одинаково для частот

и

), является независимой случайной величиной, имеющей нормальное распределение, математическое ожидание равное нулю и дисперсию равную единице.

При выполнении условия на вещественность реализаций случайную функцию (20) можно записать как (22):

Поскольку и

симметричны относительно

и

) , то во втором интеграле в (22) можно перейти к области интегрирования

заменив знак перед частотой. В этом случае получим:

Выполнив далее преобразования, получим:

- Поскольку каждое значение

(для пар частот

и

)) является независимой комплексной случайной величиной, с математическим ожиданием равным нулю и дисперсией равной единице, мы можем получить (25) - аналог выражения (7), минимизация которого при выполнении ограничений на узлы интерполяции обеспечит наиболее вероятную реализацию.

Для двух любых реализаций, имеющих одинаковую априорную вероятность значение (25) должно иметь одинаковое значение.

Выражение (25) можно записать как (26):

Пусть последовательность и соответствующие им

- представляют собой узлы интерполяции. Тогда используя полученное выражение (24) ограничения на эти узлы будут представлять собой систему уравнений:

Поиск наиболее вероятной реализации будет соответствовать нахождению функций и

таких, при которых выполняются условия (27) и минимизируется значение выражения (26).

- Дальнейшие рассуждения можно выполнить аналогично (8) – (16).

- Функция Лагранжа примет вид:

При дифференцировании (28) по можно снова получить систему (27).

Поскольку любое значение функций и

для произвольного

выражения (28) можно считать независимой переменной, то соответственно по каждому из них можно выполнить независимое дифференцирование. В этом случае получим выражения:

Подставив решения (29) и (30) в систему (24) получим выражение наиболее вероятной реализации:

Выражение (31) преобразуется в (32):

Поскольку подынтегральное выражение в (32) инвариантно к изменению на

, то мы можем перейти целиком в область интегрирования

:

Дисперсия случайной функции. Множество реализаций, удовлетворяющих узлам интерполяции.

Многомерная аппроксимация.

Выводы.

Метод машинного обучения.

Выпишем отдельно ключевые выражения, полученные в теоретической части в виде законченного метода.

- Пусть последовательность

представляет собой набор входных векторов для обучения. Пусть соответствующие им

представляют собой набор выходных значений. Если значения на выходе представляют собой не один, а набор значений (вектора), то представленные преобразования можно рассмотреть последовательно для каждого из выходных параметров.

- Метод позволяет определить функцию, связывающую значения на входе и на выходе (которая будет являться наиболее вероятной реализацией случайной функции, о чем шла речь в теоретической части). Метод также позволяет для произвольного входного значения определить среднеквадратическое отклонение ошибки, которую может дать полученная функция.

Функция, связывающая значения обучающей выборки на входе и на выходе будет определяться выражением (103):

Функцию из (103) определим как (104):

где - коэффициенты

- норма (длина) вектора

Коэффициенты для (103) вычисляются из системы линейных уравнений (105):

где

- Значения

определяют априорно предполагаемый уровень шума (погрешности) в данных обучения и соответственно степень приближения, с которой функция (103) воспроизведет данные обучения.

- Если

, то это будет соответствовать частному случаю, когда погрешность или любая противоречивость в данных отсутствует и, искомая функция должна точно воспроизвести обучающую выборку. Т.е. задача обучения превращается в задачу многомерной интерполяции.

- Если

, то это будет соответствовать случаю, когда предполагается что в данных обучения одинаково на всей выборке содержится шум, имеющий нормальное распределение со среднеквадратическим отклонением равным

. Задачу обучения можно рассматривать как многомерную аппроксимацию.

- Если же уровень шума и его распределение в пространстве обучения неравномерно но известно, его наличие может быть задано в виде функции

(или достаточно только ее значений в узлах интерполяции).

Рассмотрим теперь коэффициенты в выражении (104).

- Коэффициенты

и

в “идеальном случае” должны быть приблизительно равны и устремлены в бесконечность. В реальных вычислениях в качестве этих коэффициентов можно использовать

при условии нормирования входных значений в диапазоне [-1,1] (они должны быть на несколько порядков больше диапазона изменения входных значений). С увеличением

и

разница от использования функции (104) вместо “идеальной функции” устремляется в область все более низких частот (при разложении искомой функции в спектр) измеряемыми

и все меньше влияет на результаты обучения в области параметрического пространства, где находится обучающая выборка.

- Коэффициент

,назовем его “калибровочным”, связан со свойствами априорной случайной функции. Хотя непосредственно случайные функции в представленных выражениях (103) - (105) не используются, эти выражения выведены на их основе. (Если

и обучение сводится к многомерной интерполяции, значение

можно взять произвольным, поскольку при решении системы (105) и вычислении функции (103) он сократится.)

Процедура вычисления (предлагаемый вариант):

Рис.10. Оценка желаемой дисперсии на единичном расстоянии.

- Калибровка требуется, чтобы найти баланс между возможными погрешностями, неточностями и противоречиями в данных обучения и возможной нелинейностью самой функции, связывающей вход и выход.

- Предположим известно, что искомая функция (103) проходит через некий узел. Для калибровки можно априорно задать желаемый уровень дисперсии множества возможных реализаций

на единичном расстоянии от узла. С увеличением

при вычислениях (103) – (105) все “ большая роль” будет отводиться возможной нелинейности самой функции, с уменьшением – все больше “списываться” на наличие неточностей в данных обучения. При известном

можно вычислить требуемый коэффициент

:

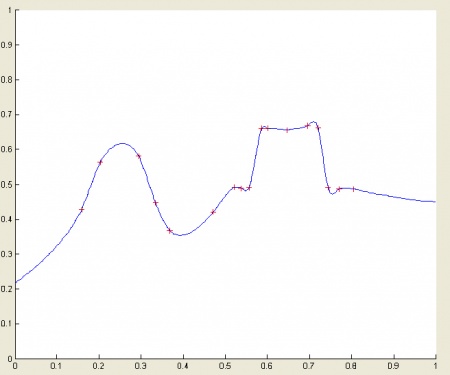

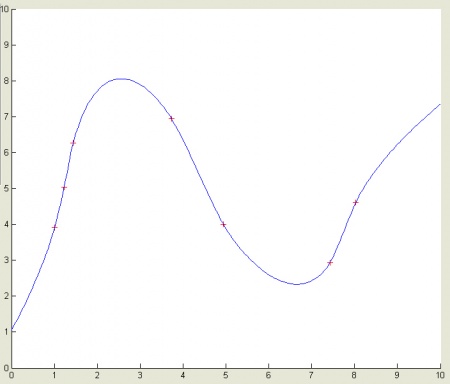

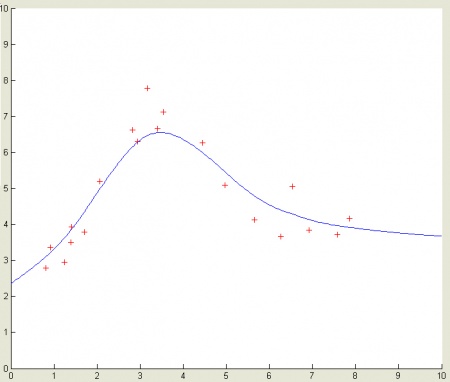

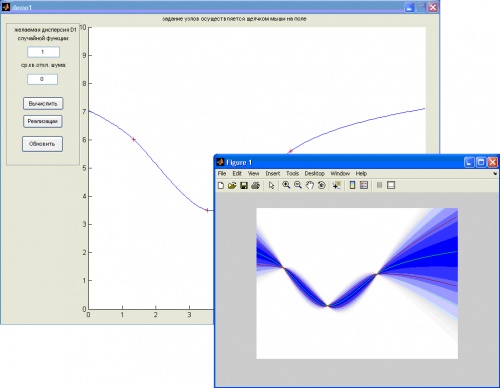

Рис.11. Пример одномерной интерполяции.

- На рис.11. представлен пример одномерной интерполяции (при

). Как видно из рисунка, интерполяция выполнена качественно (отсутствуют осцилляции, которые, например, часто имеют место при использовании интерполяционного многочлена Лагранжа).

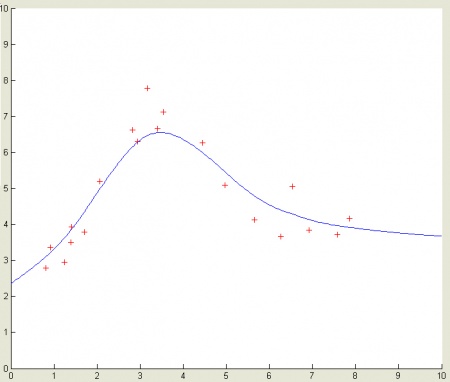

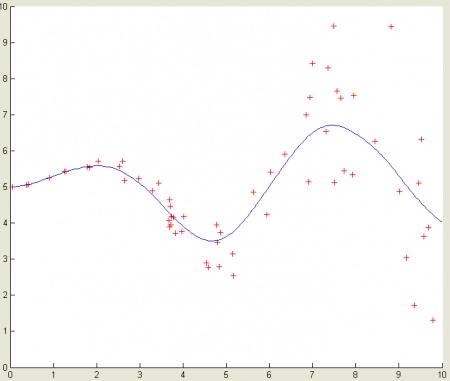

- С вводом

, интерполяция легко превращается в аппроксимацию - Рис.12.

Рис.12. Пример одномерной аппроксимации.

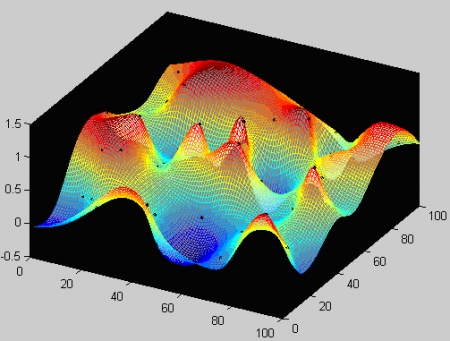

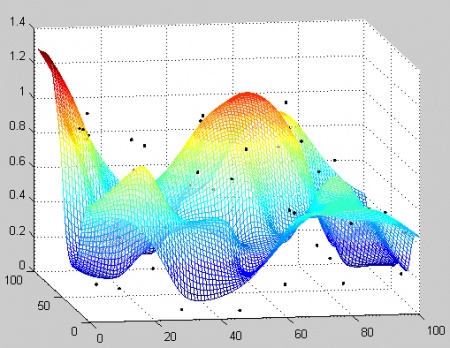

Рис.13. Пример двумерной интерполяции.

Рис.14. Пример двумерной аппроксимации.

- На Рис. 11 – 14 представлены примеры интерполяции и аппроксимации в одномерном и двумерном случае в целях наглядности результатов. Выражения (103) – (105) могут быть использованы без ограничений для пространства любой размерности.

- Для определения среднеквадратического отклонения возможной ошибки были получены выражения:

- Значение

определяется следующим выражением:

- А коэффициенты

из (108) находятся решением системы уравнений (109):

- Необходимо отметить, что при расчете среднеквадратического отклонения для каждого значения

, необходимо рассчитать индивидуальное значение

и заново решать систему уравнений (109) (хотя вычисления можно упростить, единожды вычислив обратную матрицу).

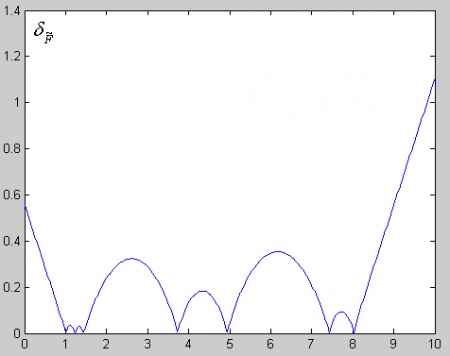

Рис.15. Пример одномерной интерполяции.

Рис.16. Среднеквадратическое отклонение распределения возможной ошибки как случайной величины для найденной функции на Рис.15

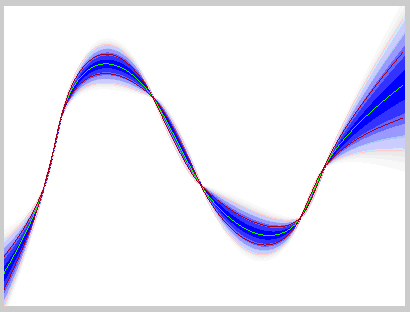

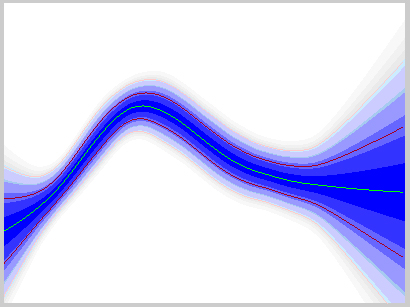

- Ожидаемая ошибка функции (103) как случайная величина (исходя из теоретических положений в первой части) будет иметь нормальное распределение с рассчитанным по (107) среднеквадратическим отклонением и математическим ожиданием равным нулю. Зная это, мы можем ее отобразить графически, как показано на Рис.17.

Рис.17. Возможная ожидаемая ошибка, или распределение реализаций случайной функции, удовлетворяющих данным обучения

- С другой стороны, то, что мы можем понимать под возможной ошибкой, представляет собой распределение значений возможных реализаций априорной случайной функции (рассмотренной в теоретической части) которые удовлетворяют данным обучения.

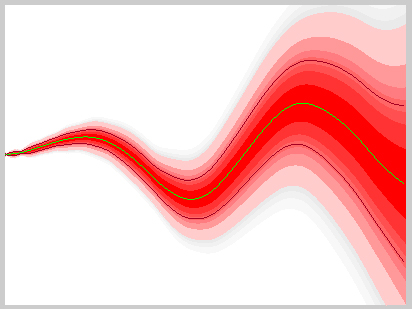

Ниже представлены рисунки, демонстрирующие аппроксимацию.

Рис.18. Пример одномерной аппроксимации.

Рис.19. Распределение реализаций или возможная ожидаемая ошибка (для функции на Рис.18).

- Среднеквадратическая ошибка в (107) отражает разброс значений связанный с возможным распределением реализаций. Если требуется учесть возможный шум в самих данных, то для вычисления среднеквадратического отклонения можно воспользоваться выражением:

Пример. Рассмотрим одномерный случай.

- Предположим, распределение шума (его среднеквадратического отклонения) в области аппроксимации определяется выражением:

- Т.е. в области около нуля шум почти отсутствует и возрастает по мере удаления.

Рис.20. Аппроксимация с учетом распределения шума.

Рис.21. Графическое отображение множества реализаций (с учетом шума).

Демонстрация в среде Matlab.

Предложенный подход к машинному обучению был реализован в виде набора функций в среде Matlab.

Ссылка [52Кб]на файл-архив с функциями.

Кроме самих функций в архиве содержатся программы-демонстрации в виде графического интерфейса пользователя в среде Matlab.

Рис.22. Демонстрация одномерной интерполяции и аппроксимации.

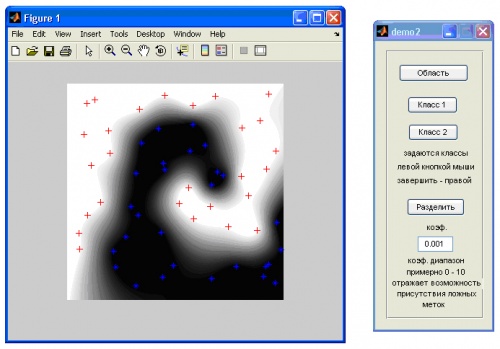

Рис.23. Демонстрация разделения двух классов на плоскости.

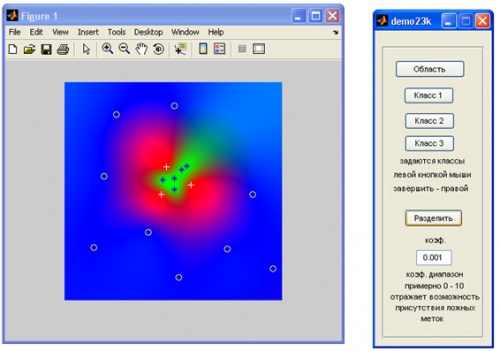

Рис.24. Разделение трех классов на плоскости.

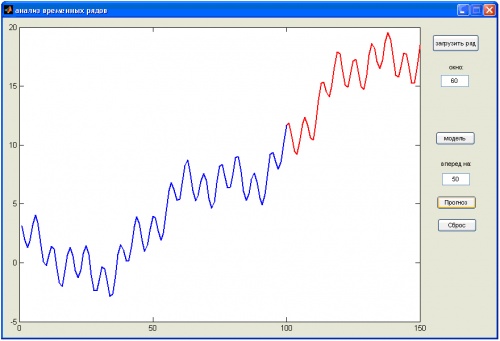

Рис.25. Продолжение временного ряда. Синим цветом – исходный ряд. Красным – прогноз на основе обучения.