Статистические свойства МНК-оценок коэффициентов регрессии

Материал из MachineLearning.

| Строка 2: | Строка 2: | ||

Однако прежде чем переходить к решению поставленной задачи, необходимо выяснить, какими '''статистическими свойствами''' обладают '''[[Метод наименьших квадратов|МНК-оценки]] коэффициентов регрессии.''' | Однако прежде чем переходить к решению поставленной задачи, необходимо выяснить, какими '''статистическими свойствами''' обладают '''[[Метод наименьших квадратов|МНК-оценки]] коэффициентов регрессии.''' | ||

| - | |||

| - | |||

==Основные обозначения== | ==Основные обозначения== | ||

| Строка 11: | Строка 9: | ||

*<tex>X=\(x_{11}\ \ \ldots\ \ x_{1k}<br>\ \vdots\ \ \ \ \ \ \ddots\ \ \ \ \vdots<br>x_{n1}\ \ \ldots\ \ x_{nk}\)\;</tex> - матрица, столбцами которой являются векторы признаков (регрессоров), а строками - объекты; | *<tex>X=\(x_{11}\ \ \ldots\ \ x_{1k}<br>\ \vdots\ \ \ \ \ \ \ddots\ \ \ \ \vdots<br>x_{n1}\ \ \ldots\ \ x_{nk}\)\;</tex> - матрица, столбцами которой являются векторы признаков (регрессоров), а строками - объекты; | ||

| - | *<tex> | + | *<tex> y= \left[ y_1 \\ ...\\ y_n\right] </tex> – зависимая переменная (отклик); |

*<tex> \theta= \left[\theta_1 \\ ...\\\theta_k \right] </tex> - коэффициенты линейной регрессии; | *<tex> \theta= \left[\theta_1 \\ ...\\\theta_k \right] </tex> - коэффициенты линейной регрессии; | ||

| - | <tex> | + | Модель линейной регрессии имеет вид: |

| + | ::<tex>y = X\theta + \varepsilon = \hat y + \varepsilon;</tex> | ||

| - | *<tex>\varepsilon = y - \hat y \; </tex> - вектор регрессионных остатков | + | *<tex>\varepsilon = y - \hat y \; </tex> - вектор регрессионных остатков; |

| - | + | ||

| - | + | ||

| - | + | ||

| - | * <tex>\hat\theta = (X^TX)^{-1}X^Ty \; </tex>- МНК-оценка коэффициентов регрессии | + | * <tex>\hat\theta = (X^TX)^{-1}X^Ty \; </tex>- МНК-оценка коэффициентов регрессии. |

==Основные Предположения== | ==Основные Предположения== | ||

| + | Для того, чтобы МНК-оценки коэффициентов регрессии обладали хорошими свойствами, необходимо выполнение ряда предпосылок, называемых ''Основными Предположениями''. | ||

| - | *'''ОП1''' <tex>X</tex> - детерминированная <tex>n\times k</tex> матрица, <tex>rkX = k</tex> (признаки линейно-независимы); | + | *'''ОП1:''' <tex>X</tex> - детерминированная <tex>n\times k</tex> матрица, <tex>rkX = k</tex> (признаки линейно-независимы); |

| - | *'''ОП2''' Регрессионные остатки <tex>\varepsilon_i, \; i=\overline{1,n}</tex> | + | *'''ОП2:''' Регрессионные остатки <tex>\varepsilon_i, \; i=\overline{1,n}</tex> |

::'''2.1.''' одинаково распределены; | ::'''2.1.''' одинаково распределены; | ||

::'''2.2.''' <tex>E\varepsilon_i = 0</tex> (модель несмещенная); | ::'''2.2.''' <tex>E\varepsilon_i = 0</tex> (модель несмещенная); | ||

| Строка 36: | Строка 33: | ||

:т.е вектор регрессионных остатков <tex>\varepsilon</tex> - [[нормальное распределение|нормально распределенный]] [[многомерная случайная величина|случайный вектор]] со [[многомерная случайная величина|средним]] 0 и [[ковариационная матрица|матрицей ковариации]] <tex>\sigma^2I_n</tex> (<tex>I_n</tex> - единичная матрица размера <tex>n\times n</tex>). В этом случаем модель называется ''нормальной линейной регрессионной моделью''. | :т.е вектор регрессионных остатков <tex>\varepsilon</tex> - [[нормальное распределение|нормально распределенный]] [[многомерная случайная величина|случайный вектор]] со [[многомерная случайная величина|средним]] 0 и [[ковариационная матрица|матрицей ковариации]] <tex>\sigma^2I_n</tex> (<tex>I_n</tex> - единичная матрица размера <tex>n\times n</tex>). В этом случаем модель называется ''нормальной линейной регрессионной моделью''. | ||

| - | + | Проверки этих предположений занимается [[Анализ регрессионных остатков]]. | |

==Свойства МНК-оценок без предположения о нормальности== | ==Свойства МНК-оценок без предположения о нормальности== | ||

| Строка 47: | Строка 44: | ||

::<tex>E\hat\theta = E((X^TX)^{-1}X^Ty) = (X^TX)^{-1}X^TEy = (X^TX)^{-1}X^TE(X\theta+\varepsilon) = (X^TX)^{-1}X^TX\theta + (X^TX)^{-1}X^TE\varepsilon = \theta;</tex> | ::<tex>E\hat\theta = E((X^TX)^{-1}X^Ty) = (X^TX)^{-1}X^TEy = (X^TX)^{-1}X^TE(X\theta+\varepsilon) = (X^TX)^{-1}X^TX\theta + (X^TX)^{-1}X^TE\varepsilon = \theta;</tex> | ||

* Матрица ковариации равна: | * Матрица ковариации равна: | ||

| - | ::<tex>cov\hat\theta = ||cov(\hat\theta_i,\hat\theta_j)||_{i=1,\cdots,k}^{j=1,\cdots,k} = \sigma^2(X^TX)^{-1} | + | ::<tex>cov\hat\theta = ||cov(\hat\theta_i,\hat\theta_j)||_{i=1,\cdots,k}^{j=1,\cdots,k} = \sigma^2(X^TX)^{-1};</tex> |

* МНК-оценка <tex>\hat\theta</tex> '''эффективна'''. | * МНК-оценка <tex>\hat\theta</tex> '''эффективна'''. | ||

Версия 13:50, 29 января 2009

Статистическое исследование линейной регрессии включает в себя построение доверительных интервалов для коэффициентов регрессии и прогнозного значения отклика.

Однако прежде чем переходить к решению поставленной задачи, необходимо выяснить, какими статистическими свойствами обладают МНК-оценки коэффициентов регрессии.

Содержание |

Основные обозначения

Ввдедем матричные обозначения:

- матрица, столбцами которой являются векторы признаков (регрессоров), а строками - объекты;

– зависимая переменная (отклик);

- коэффициенты линейной регрессии;

Модель линейной регрессии имеет вид:

- вектор регрессионных остатков;

-

- МНК-оценка коэффициентов регрессии.

Основные Предположения

Для того, чтобы МНК-оценки коэффициентов регрессии обладали хорошими свойствами, необходимо выполнение ряда предпосылок, называемых Основными Предположениями.

- ОП1:

- детерминированная

матрица,

(признаки линейно-независимы);

- ОП2: Регрессионные остатки

- 2.1. одинаково распределены;

- 2.2.

(модель несмещенная);

- 2.3.

(гомоскедастичность);

- 2.4.

(некореллированность).

- Дополнительное Предположение 3 (ДП3):

,

- т.е вектор регрессионных остатков

- нормально распределенный случайный вектор со средним 0 и матрицей ковариации

(

- единичная матрица размера

). В этом случаем модель называется нормальной линейной регрессионной моделью.

Проверки этих предположений занимается Анализ регрессионных остатков.

Свойства МНК-оценок без предположения о нормальности

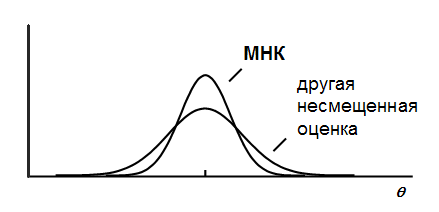

Теорема Гаусса-Маркова. Пусть выполнены ОП1 и ОП2. Тогда оценка полученная по методу наименьших квадратов является эффективной в классе линейных несмещенных оценок (Best Linear Unbiased Estimator, BLUE).

Исходя из этой теоремы можно выделить несколько основных свойств МНК-оценки

- Линейность:

-

где

-

- Несмещенность:

- Матрица ковариации равна:

- МНК-оценка

эффективна.

Итак, теорема Гаусса-Маркова утверждает, что любая другая линейная несмещенная оценка будет иметь большую дисперсию, чем МНК-оценка:

Нетрудно показать, что для любого вектора оценка

будет обладать теми же свойствами, что и МНК-оценка

. Поэтому:

- если взять

то получим что

- несмещенная, эффективная оценка

- если

то

- несмещенная, эффективная оценка

Свойства МНК-оценок с предположением о нормальности

Пусть теперь к тому же выполнено ДП3, т.е. - многомерная нормально распределенная случайная величина, или, что то же самое

имеют совместное нормальное распределение. Тогда к перечисленным выше свойствам добавятся следующие:

- МНК-оценка коэффициентов регрессии

имеет нормальное распределение:

- Несмещенная оценка для дисперсии шума

имеет вид:

- где RSS есть остаточная сумма квадратов;

- Случайная величина

- распределена по закону хи-квадрат с

степенями свободы;

- Оценки

и

линейно независимы. Откуда получается, что величина

- имеет распределение Стьюдента с

степенями свободы.

Литература

- Кобзарь А. И. Прикладная математическая статистика. — М.: Физматлит, 2006.

- Магнус Я. Р., Катышев П. К., Пересецкий А. А. Эконометрика. Начальный курс: Учеб. — 7-е изд., испр. — М.: Дело, 2005.